20/02/2018

I datalogiens verden er effektivitet altafgørende. Når vi skriver kode og udvikler software, er det ikke nok, at programmet virker – det skal også køre hurtigt og håndtere store mængder data uden at bryde sammen. Her kommer Big O-notation ind i billedet. Det er et kraftfuldt matematisk værktøj, der bruges til at beskrive en algoritmes tids- eller pladskompleksitet. Big O giver os et sprog til at tale om, hvordan en algoritmes ydeevne skalerer, efterhånden som inputstørrelsen vokser, hvilket er essentielt for at bygge robuste og skalerbare systemer.

Hvad er Big O-notation Præcist?

Big O-notation er en måde at udtrykke den øvre grænse for en algoritmes tids- eller pladsforbrug. I stedet for at måle den præcise køretid i sekunder – hvilket kan variere afhængigt af computerens hardware og andre faktorer – fokuserer Big O på den asymptotiske adfærd. Det vil sige, hvordan algoritmens ressourceforbrug vokser i forhold til størrelsen på inputdataene (betegnet som 'n').

Det bruges primært til at sammenligne effektiviteten af forskellige algoritmer og datastrukturer. Når vi analyserer en algoritme med Big O, ser vi typisk på det værst tænkelige scenarie (worst-case scenario) for at garantere en øvre grænse for ydeevnen. Notationen skrives som O(f(n)), hvor f(n) er en funktion, der repræsenterer antallet af operationer, en algoritme udfører for at løse et problem af størrelse 'n'.

Den Formelle Definition

Matematisk set siger vi, at en funktion f(n) er O(g(n)), hvis der eksisterer positive konstanter 'c' og 'n₀', således at f(n) ≤ c * g(n) for alle n ≥ n₀. I mere enkle vendinger betyder det, at f(n) ikke vokser hurtigere end g(n), når 'n' bliver tilstrækkeligt stort.

Hvorfor er Big O Vigtigt?

Forståelse af Big O-notation er afgørende for enhver softwareudvikler af flere årsager:

- Effektivitetsanalyse: Det giver en standardiseret metode til at analysere og sammenligne algoritmers effektivitet.

- Skalerbarhed: Det hjælper med at forudsige, hvordan en algoritme vil opføre sig, når mængden af data vokser. En algoritme, der er hurtig med 10 elementer, kan blive ubrugelig langsom med 10 millioner.

- Valg af Algoritme: Det gør det muligt for udviklere at vælge den mest effektive algoritme til et specifikt problem, hvilket sparer computerressourcer og forbedrer brugeroplevelsen.

- Kodeoptimering: Ved at identificere flaskehalse i koden med høj tidskompleksitet kan udviklere fokusere deres optimeringsindsats, hvor det har størst betydning.

En Hurtig Metode til at Finde Big O

For at bestemme Big O for et matematisk udtryk, kan man følge to simple regler:

- Ignorer led af lavere orden: I et polynomium er det kun leddet med den højeste eksponent, der har betydning, når 'n' bliver stort.

- Ignorer konstante faktorer: Da Big O beskriver vækstraten, er konstante multiplikatorer irrelevante. O(2n) er det samme som O(n).

Eksempel 1: f(n) = 3n² + 2n + 1000 * log(n) + 5000

- Højeste ordens led er 3n².

- Efter at have ignoreret konstanten 3, får vi n².

- Derfor er Big O for dette udtryk O(n²).

Eksempel 2: f(n) = 3n³ + 2n² + 5n + 1

- Det dominerende led er 3n³.

- Vækstordenen er kubisk (n³).

- Big O-notationen er O(n³).

Almindelige Big O-kompleksiteter

Der findes flere almindelige klasser af tidskompleksitet, som enhver udvikler bør kende. Her er de mest gængse, sorteret fra mest til mindst effektiv.

O(1) - Konstant Tid

Algoritmen tager den samme mængde tid, uanset inputstørrelsen. Et eksempel er at slå en værdi op i en hash-tabel eller tilgå et element i et array via dets indeks.

O(log n) - Logaritmisk Tid

Køretiden vokser logaritmisk med inputstørrelsen. Hver gang inputstørrelsen fordobles, øges antallet af operationer kun med en konstant mængde. Binær søgning er et klassisk eksempel.

O(n) - Lineær Tid

Køretiden vokser lineært og i direkte proportion med inputstørrelsen. Et eksempel er at gennemløbe alle elementer i en liste for at finde en bestemt værdi.

O(n log n) - Superlineær Tid

Dette er en meget almindelig og effektiv kompleksitet for sorteringsalgoritmer. Kendte eksempler inkluderer Merge Sort og Heap Sort.

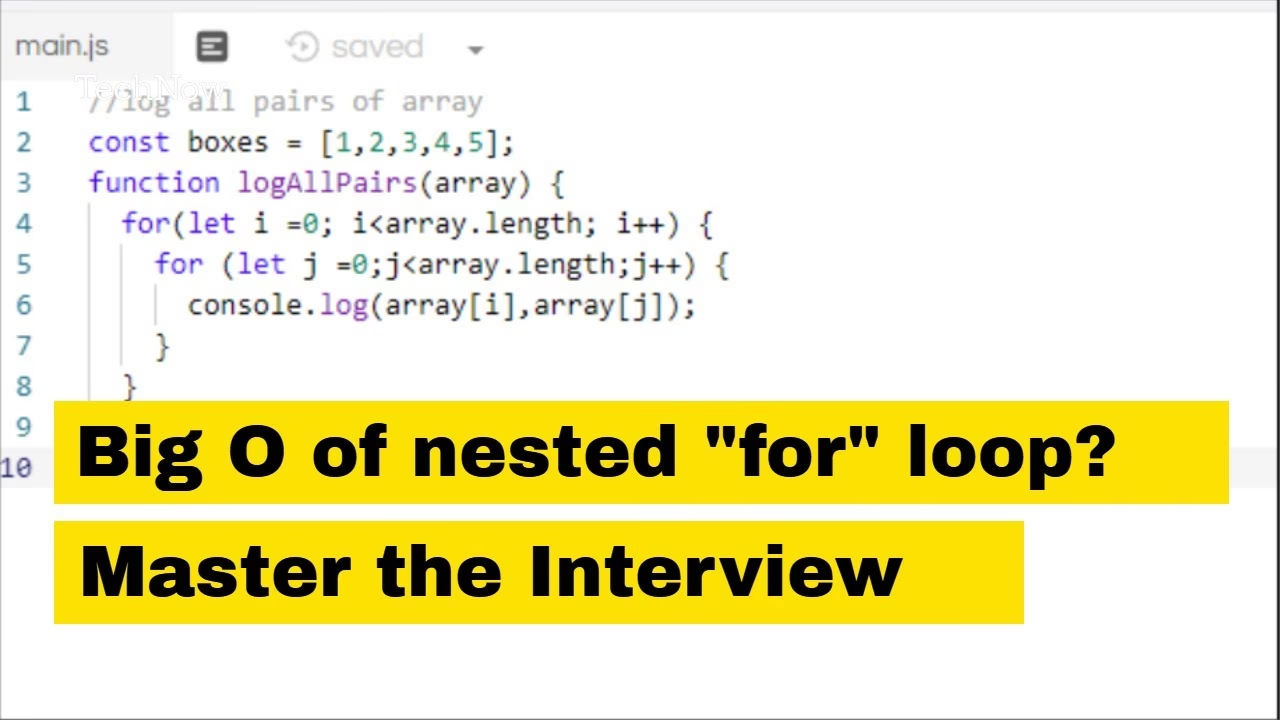

O(n²) - Kvadratisk Tid

Køretiden er proportional med kvadratet af inputstørrelsen. Dette ses ofte i algoritmer, der involverer indlejrede løkker over datasættet, såsom Bubble Sort eller ved sammenligning af hvert element i et sæt med hvert andet element.

O(2ⁿ) - Eksponentiel Tid

Køretiden fordobles for hvert ekstra element i inputdataene. Disse algoritmer bliver hurtigt upraktiske for selv relativt små 'n'. Et eksempel er at generere alle delmængder af et sæt.

O(n!) - Faktoriel Tid

Køretiden vokser ekstremt hurtigt. Disse algoritmer er kun praktiske for meget små inputstørrelser. At finde alle permutationer af en liste eller løse Traveling Salesman-problemet med brute force er eksempler på dette.

Sammenligning af Vækstrater

For at illustrere forskellen i ydeevne mellem disse klasser, kan vi se på antallet af operationer for en given inputstørrelse 'n'.

| n | O(log n) | O(n) | O(n log n) | O(n²) | O(2ⁿ) | O(n!) |

|---|---|---|---|---|---|---|

| 10 | ~3 | 10 | ~33 | 100 | 1.024 | 3.628.800 |

| 20 | ~4 | 20 | ~86 | 400 | 1.048.576 | ~2.43 x 10¹⁸ |

| 50 | ~6 | 50 | ~282 | 2.500 | ~1.12 x 10¹⁵ | Meget stort |

Som tabellen tydeligt viser, eksploderer antallet af operationer for algoritmer med kvadratisk, eksponentiel og faktoriel kompleksitet, hvilket understreger vigtigheden af at vælge en effektiv algoritme, især når man arbejder med stor dataindsamling.

Sammenligning: Big O, Big Ω (Omega) og Big θ (Theta)

Big O er den mest anvendte notation, men der findes også to andre, som beskriver nedre og stramme grænser for en algoritmes køretid.

| Notation | Definition | Forklaring |

|---|---|---|

| Big O (O) | f(n) ≤ C * g(n) | Beskriver den øvre grænse (worst-case). Algoritmen vil aldrig være langsommere end dette. |

| Big Ω (Omega) | f(n) ≥ C * g(n) | Beskriver den nedre grænse (best-case). Algoritmen vil aldrig være hurtigere end dette. |

| Big θ (Theta) | C₁ * g(n) ≤ f(n) ≤ C₂ * g(n) | Beskriver en stram grænse (average-case). Algoritmens vækstrate er præcis g(n). |

Selvom alle tre er nyttige, er Big O den mest anvendte i praksis, fordi vi ofte er mest interesserede i at kende det værst tænkelige scenarie for at sikre, at vores software forbliver responsivt.

Ofte Stillede Spørgsmål (FAQ)

Hvad er Big O-notation i simple vendinger?

Det er en måde at klassificere en algoritme baseret på, hvordan dens køretid eller pladsforbrug vokser, når inputstørrelsen øges. Det handler om skalerbarhed, ikke præcis hastighed.

Hvorfor ignorerer man konstanter i Big O?

Konstanter afhænger af hardware og implementeringsdetaljer. Big O fokuserer på den grundlæggende vækstrate, som er uafhængig af disse faktorer. En algoritme, der er O(2n), og en der er O(100n), har begge den samme lineære vækstrate.

Hvad er den praktiske forskel på O(n) og O(n²)?

En O(n) algoritme skalerer godt. Hvis du fordobler input, fordobles køretiden. En O(n²) algoritme skalerer dårligt. Hvis du fordobler input, firdobles køretiden. For store datasæt bliver denne forskel dramatisk.

Er O(1) altid den bedste løsning?

Ja, en algoritme med O(1) tidskompleksitet er den mest effektive, da dens ydeevne er uafhængig af inputstørrelsen. Det er dog ikke altid muligt at opnå for alle typer af problemer.

Konklusion

Big O-notation er mere end blot et teoretisk koncept for akademikere; det er et fundamentalt og praktisk værktøj for enhver, der arbejder med softwareudvikling. Ved at forstå og anvende principperne bag Big O kan du skrive mere effektiv, skalerbar og professionel kode. Det giver dig mulighed for at træffe informerede beslutninger om datastrukturer og algoritmer, hvilket i sidste ende fører til bedre og hurtigere applikationer.

Hvis du vil læse andre artikler, der ligner Forstå Big O-notation: En Guide til Effektivitet, kan du besøge kategorien Teknologi.