07/06/2003

I vores daglige interaktion med computere, smartphones og internettet tænker vi sjældent over de komplekse kræfter, der arbejder i baggrunden. Kernen i enhver enhed er et operativsystem (OS), der styrer hardware og software. Men når opgaverne bliver ekstremt krævende – som f.eks. i videnskabelig forskning, store dataanalyser eller drift af globale internettjenester – er et standard-OS ikke længere tilstrækkeligt. Her kommer to avancerede arkitekturer i spil: parallelle og distribuerede systemer. Selvom de begge udnytter flere processorer til at løse problemer, er deres fundamentale design og formål vidt forskellige. Denne artikel vil afmystificere disse to teknologier, forklare deres kerneforskelle, fordele, ulemper og hvordan de driver den moderne digitale verden.

Hvad er et Parallelt System?

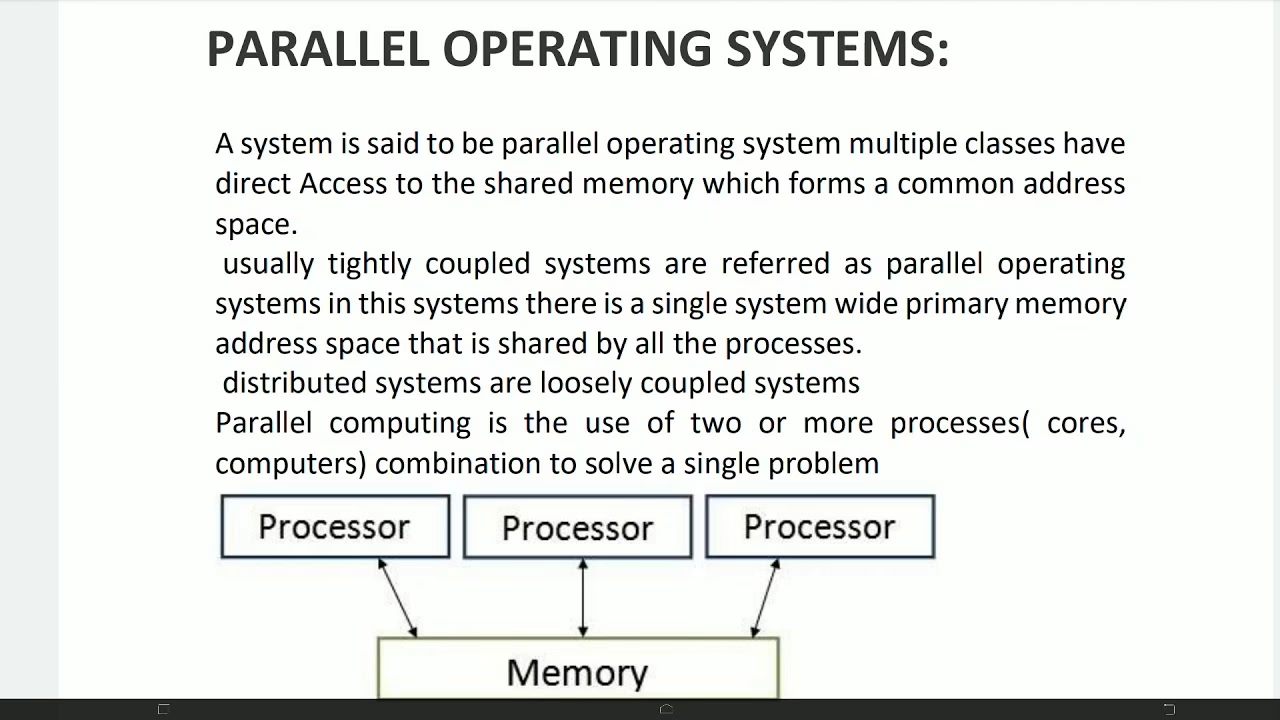

Et parallelt system, ofte kaldet et tætkoblet system, er designet til at accelerere udførelsen af et enkelt program ved at opdele det i mindre fragmenter og behandle disse fragmenter samtidigt. Forestil dig et enkelt, ekstremt kraftfuldt computerkabinet, der indeholder flere processorer (CPU'er) eller processorkerner. Alle disse processorer arbejder sammen om den samme opgave. Det afgørende kendetegn ved et parallelt system er, at alle processorerne deler de samme computerressourcer. De har adgang til en fælles hukommelse (RAM), et fælles ur til synkronisering og de samme perifere enheder som harddiske og netværkskort. Kommunikation mellem processorerne er ekstremt hurtig, da den foregår internt i computeren via en højhastighedsbus.

Formålet er ren og skær hastighed. Ved at kaste flere processorer efter et enkelt, beregningsintensivt problem kan man reducere den samlede behandlingstid dramatisk. Dette er afgørende inden for områder som højtydende databehandling (High-Performance Computing), vejrsimuleringer, komplekse finansielle modeller og gengivelse af 3D-grafik.

Flynn's Klassifikation

En måde at kategorisere parallelle systemer på er gennem Flynn's taksonomi, som ser på parallelisme i instruktions- og datastrømme:

- Single Instruction, Single Data (SISD): En traditionel enkeltprocessorcomputer.

- Single Instruction, Multiple Data (SIMD): En enkelt instruktion udføres på flere forskellige data samtidigt. Bruges ofte i grafikprocessorer (GPU'er).

- Multiple Instruction, Single Data (MISD): Flere instruktioner opererer på den samme datastrøm. En sjælden arkitektur.

- Multiple Instruction, Multiple Data (MIMD): Flere processorer udfører forskellige instruktioner på forskellige data samtidigt. Dette er den mest almindelige type for moderne parallelle systemer.

Hvad er et Distribueret System?

Et distribueret system, også kendt som et løstkoblet system, er en model, hvor flere uafhængige computere er forbundet via et kommunikationsnetværk (som internettet eller et lokalt netværk). For brugeren eller applikationen fremstår dette netværk af computere ofte som ét enkelt, sammenhængende system. Hver computer i netværket, ofte kaldet en 'node', har sin egen lokale hukommelse, sin egen processor og sit eget operativsystem. De deler ikke hukommelse eller et ur. Al kommunikation og koordinering mellem noderne sker ved at sende beskeder over netværket.

Hvor parallelle systemer fokuserer på at fremskynde én opgave, fokuserer distribuerede systemer på skalerbarhed, fejltolerance og ressourcedeling over et potentielt stort geografisk område. Internettet er det ultimative eksempel på et distribueret system. Cloud computing-platforme som Amazon Web Services (AWS) og Google Cloud er andre fremragende eksempler, hvor tusindvis af servere arbejder sammen for at levere tjenester. Eksempler på distribuerede operativsystemer inkluderer LOCUS og MICROS.

Sammenligningstabel: Parallel vs. Distribueret System

For at give et klart overblik er her en direkte sammenligning af de vigtigste egenskaber ved de to systemtyper.

| Egenskab | Parallelt System | Distribueret System |

|---|---|---|

| Arkitektur | Tætkoblet (flere processorer i én computer) | Løstkoblet (flere uafhængige computere i et netværk) |

| Hukommelse | Delt hukommelse for alle processorer | Hver computer (node) har sin egen private hukommelse |

| Ur | Et enkelt, globalt master-ur for synkronisering | Intet globalt ur; synkronisering sker via algoritmer |

| Kommunikation | Meget hurtig, via den delte hukommelse eller en intern bus | Langsommere, via netværksbeskeder (f.eks. TCP/IP) |

| Formål | Forbedre ydeevnen og fremskynde en enkelt, stor opgave | Ressourcedeling, skalerbarhed og høj fejltolerance |

| Skalerbarhed | Begrænset af den fysiske computerramme | Meget høj; nye computere kan tilføjes til netværket |

| Fejltolerance | Generelt lav; en fejl i en kernekomponent kan stoppe hele systemet | Høj; hvis en node fejler, kan andre tage over |

| Eksempler | Supercomputere, multi-core processorer, Beowulf clusters | Internettet, cloud computing, Hadoop, Apache Cassandra |

Fordele og Ulemper Udpakket

Fordele ved Parallelle Systemer

- Høj Ydeevne: Den primære fordel. Kan løse massive beregningsopgaver markant hurtigere end en enkeltprocessor-system.

- Omkostningseffektivitet: At samle flere standardprocessorer i ét system kan være mere omkostningseffektivt end at bygge en enkelt, ekstremt hurtig specialiseret processor.

Ulemper ved Parallelle Systemer

- Begrænset Skalerbarhed: Du kan kun tilføje et begrænset antal processorer til et enkelt bundkort, før fysiske og elektriske begrænsninger sætter en stopper.

- Kompleksitet i Programmering: At skrive software, der effektivt kan udnytte flere processorer, er en stor udfordring. Udviklere skal håndtere synkronisering og dataadgang for at undgå konflikter.

- Synkroniseringsomkostninger: Der er et overhead forbundet med at koordinere arbejdet mellem processorerne. Nogle gange må en processor vente på en anden, hvilket reducerer den samlede effektivitet.

Fordele ved Distribuerede Systemer

- Enorm Skalerbarhed: Systemet kan vokse ved simpelthen at tilføje flere computere til netværket. Dette giver næsten ubegrænset skalerbarhed.

- Fejltolerance: Systemet kan designes til at være yderst robust. Hvis en computer går ned, kan dens opgaver omfordeles til andre fungerende computere i netværket uden at hele systemet fejler.

- Geografisk Spredning: Noder kan placeres over hele verden. Dette kan forbedre ydeevnen ved at placere data og beregningskraft tættere på brugerne og øge robustheden mod lokale katastrofer.

Ulemper ved Distribuerede Systemer

- Kompleksitet i Design: At designe, bygge og vedligeholde et distribueret system er væsentligt mere kompliceret end et enkelt computersystem.

- Kommunikationsomkostninger: Kommunikation over et netværk er mange størrelsesordener langsommere end kommunikation inden i en computer. Denne forsinkelse (latency) kan blive en flaskehals for ydeevnen.

- Sikkerhed: Et distribueret system har mange flere potentielle angrebspunkter. Kommunikation mellem computere kan opsnappes, og kompromittering af en enkelt node kan true hele netværket.

Fremtidens Operativsystemer: En Transparent Bro?

Traditionelt har udviklere skullet vælge, om de vil skrive kode til et parallelt system eller et distribueret system. Men forskning i nye operativsystemer sigter mod at bygge en bro mellem disse to verdener. Målet er at understøtte 'transparent' udførelse af parallelle algoritmer i et distribueret miljø. Forestil dig, at en udvikler kan skrive en parallel applikation til en enkelt computer, og operativsystemet vil automatisk og intelligent håndtere distributionen af denne applikation over et netværk af computere. Dette ville dramatisk reducere udviklingsindsatsen og gøre det muligt for applikationer at skalere problemfrit fra en enkelt multi-core laptop til en hel sky af servere. Dette repræsenterer en spændende fremtid, hvor grænserne mellem parallel og distribueret databehandling bliver mere flydende.

Ofte Stillede Spørgsmål (FAQ)

Hvad er den simpleste måde at forstå forskellen på?

Tænk på et parallelt system som et team af kirurger, der arbejder tæt sammen omkring det samme operationsbord for at udføre én kompliceret operation hurtigere. Et distribueret system er som et netværk af hospitaler over hele landet, hvor hvert hospital arbejder på sin del af et stort nationalt sundhedsprogram.

Er parallelle systemer altid hurtigere?

For en enkelt, selvstændig og beregningsintensiv opgave er et parallelt system næsten altid hurtigere. Men for opgaver, der kræver høj tilgængelighed, er naturligt spredte eller skal håndtere mange samtidige, uafhængige anmodninger (som en stor hjemmeside), er et distribueret systems arkitektur ofte mere robust og effektivt samlet set.

Hvad betyder 'kobling' (coupling) i denne sammenhæng?

'Kobling' beskriver, hvor tæt og afhængige systemets komponenter (processorerne) er af hinanden. Tætkoblet betyder, at de er stærkt afhængige, deler centrale ressourcer som hukommelse og er i konstant, hurtig kommunikation. Løstkoblet betyder, at de er mere uafhængige, har egne ressourcer og kommunikerer over et langsommere, mere formelt netværk.

Hvis du vil læse andre artikler, der ligner Parallel vs. Distribuerede Operativsystemer, kan du besøge kategorien Teknologi.