11/07/2016

Medicinsk ræsonnement er en utrolig kompleks proces. Opgaver som diagnostik og behandlingsplanlægning, især inden for livskritiske områder, kræver præcise, omhyggelige og verificerbare tankeprocesser. I modsætning til ren matematisk logik, hvor der ofte findes et enkelt korrekt svar, navigerer medicin i en verden af usikkerhed, nuancer og menneskelig biologi. Med fremkomsten af kunstig intelligens (AI) står vi over for en potentiel revolution i sundhedsvæsenet. Men spørgsmålet er ikke længere, *om* AI kan bruges, men *hvordan* vi bedst implementerer denne kraftfulde teknologi. Skal AI være en autonom beslutningstager, der erstatter menneskelig ekspertise, eller en intelligent partner, der forstærker lægens evner? Svaret på dette spørgsmål vil forme fremtidens patientbehandling.

De nuværende faldgruber for AI i sundhedsvæsenet

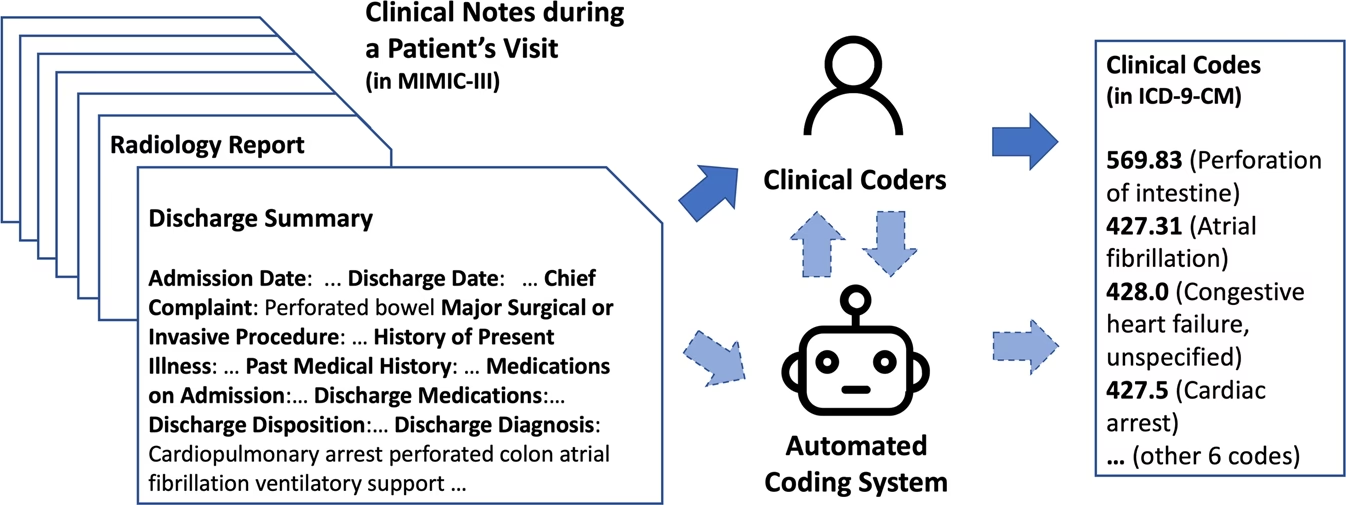

Mange af nutidens AI-værktøjer, der udvikles til medicinsk brug, lider under en fundamental fejlslutning. De er ofte designet som datadrevne systemer, der primært trænes til at efterligne menneskelige beslutninger. Målet bliver at opnå en høj forudsigelsesnøjagtighed ved at sammenligne AI'ens konklusion med en menneskelig eksperts. Selvom dette lyder fornuftigt, skaber det en række problemer i den virkelige verden. Disse systemer ender ofte med at være upraktiske og mangler det, man kalder økologisk validitet – de fungerer simpelthen ikke godt i det komplekse og dynamiske miljø, en klinik eller et hospital udgør.

Problemet forværres, når disse AI-værktøjer præsenterer brugeren – lægen – for en færdiglavet konklusion i stedet for reelt at understøtte beslutningsprocessen. Dette konkurrerer med og begrænser lægens egen dømmekraft. I stedet for at være en hjælpende hånd bliver AI'en en sort boks, der dikterer et svar. Dette kan føre til en farlig afhængighed og det, der kaldes automatisering-bias, hvor man ukritisk stoler på teknologiens output. Endnu værre er det, at det kan erodere værdien af ekspertise, forstyrre veletablerede arbejdsgange og i sidste ende fratage fagfolk deres handlekraft.

I værste fald kan en AI, der er trænet på historiske data, utilsigtet forstærke de kognitive fejl, som selv erfarne læger kan begå. To af de mest almindelige diagnostiske fejl er:

- Forankring (Anchoring): En tendens til at holde fast i det første indtryk og ignorere efterfølgende beviser, der peger i en anden retning.

- Forhastet lukning (Premature closure): At springe til en konklusion uden at have overvejet alle tilgængelige og nødvendige oplysninger.

Disse bias påvirker læger uanset deres erfaringsniveau, og hvis et AI-system trænes på data, der afspejler disse fejl, vil det lære at gentage og dermed cementere dem, hvilket potentielt kan underminere patientplejen.

En ny vision: AI som en kognitiv partner

For at overvinde disse udfordringer er der behov for et fundamentalt skift i, hvordan vi designer og implementerer AI-systemer. I stedet for at stræbe efter at erstatte mennesker, bør vi skabe AI, der er motiveret af de konkrete behov og udfordringer, som læger står over for. Teknologien skal hjælpe mennesker med at overvinde deres begrænsninger og samtidig fremhæve deres styrker.

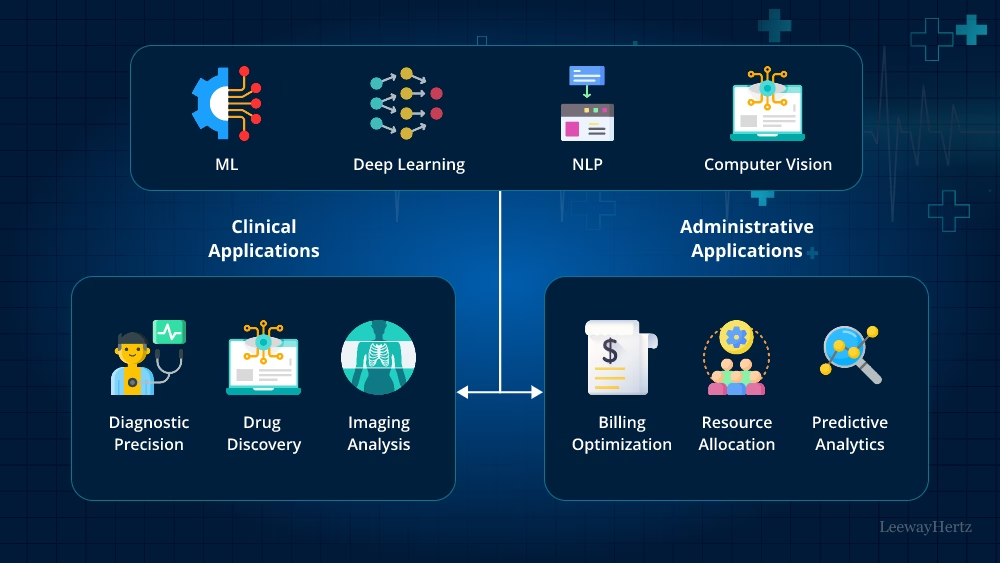

Denne vision handler om menneske-maskine symbiose. AI har potentialet til at blive et kraftfuldt værktøj, der kan forbedre specifikke kognitive opgaver. Forestil dig et system, der ikke bare giver et svar, men i stedet:

- Udfylder huller i viden: Præsenterer relevant og opdateret forskning, som lægen måske ikke har haft tid til at læse.

- Udfordrer antagelser: Foreslår alternative diagnoser og tvinger lægen til at overveje andre muligheder, hvilket direkte modvirker forankring og forhastet lukning.

- Simulerer scenarier: Hjælper med at simulere potentielle udfald af forskellige behandlingsplaner baseret på store mængder data.

- Fremmer kritisk tænkning: Organiserer og præsenterer data på en måde, der stimulerer lægens egen ræsonnement i stedet for at kortslutte den.

I denne model forbliver ansvaret hos det menneskelige sundhedspersonale. AI bliver et avanceret værktøj, der leverer støttende information inden for de velkendte rammer af evidensbaseret medicin. Dette løser også et stort etisk dilemma: Hvem har ansvaret, når en fuldautomatisk AI begår en fejl? Ved at bevare mennesket i centrum af beslutningsprocessen er ansvarsfordelingen klar.

Fra "Tillid" til "Pålidelighed": At bygge sikker AI

Når vi taler om teknologi, er begrebet "tillid" ofte malplaceret. Vi stoler ikke på en hammer; vi forventer, at den er pålidelig og robust. Det samme bør gælde for AI. Integrationen af AI kan ikke baseres på, at læger over tid udvikler en følelsesmæssig tillid til systemet. Den skal baseres på en teknisk garanti for pålidelighed og robusthed.

Her er det vigtigt at skelne mellem to former for AI-transparens:

- Post-hoc forklarbarhed: Dette er den mest almindelige tilgang. Her forsøger man at forklare, hvorfor en kompleks "sort boks"-model nåede frem til en bestemt konklusion. Problemet er, at disse forklaringer er forenklinger og ikke nødvendigvis afspejler modellens sande interne logik. De kan være vildledende og er derfor uacceptable i sikkerhedskritiske anvendelser som medicin.

- Ante-hoc fortolkelighed: Her er modellen designet fra bunden til at være gennemsigtig og forståelig for mennesker. Selve modellens struktur er begrænset for at sikre, at dens beslutningsprocesser er logiske og kan efterprøves. Denne tilgang leverer det solide fundament, der er nødvendigt for at bygge menneskecentrerede, sikre og pålidelige AI-systemer til sundhedsvæsenet.

Sammenligning af AI-tilgange i medicin

| Karakteristik | AI som Afløser (Fuld Automatisering) | AI som Partner (Menneske-Maskine Symbiose) |

|---|---|---|

| Mål | Erstatte menneskelig beslutningstagning for at opnå overmenneskelig præstation. | Forstærke og understøtte menneskelig ekspertise og dømmekraft. |

| Menneskets Rolle | Overvåger eller godkender AI'ens konklusioner. Reduceret autonomi. | Aktiv beslutningstager, der bruger AI som et avanceret værktøj. Fuld autonomi. |

| Ansvar | Uklart. Hvem er ansvarlig ved fejl – udvikleren, hospitalet, AI'en? | Klart defineret. Lægen eller det kliniske team er ansvarlig. |

| Designfilosofi | Fokuserer på forudsigelsesnøjagtighed, ofte via "sort boks"-modeller. | Fokuserer på pålidelighed og fortolkelighed (ante-hoc). |

| Potentiel Risiko | Automatisering-bias, forstærkning af kognitive fejl, devaluering af ekspertise. | Kræver omhyggelig integration i arbejdsgange og træning af personale. |

Integration i et komplekst system

For at AI skal blive en succes, skal vi se på det som mere end bare et stykke software. Det skal integreres i den komplekse sociale og organisatoriske struktur, som et hospital er. Tænk på en MR-scanner. De fleste læger forstår ikke i detaljer den underliggende fysik eller signalbehandling, der skaber billederne. De kan alligevel trygt bruge resultaterne, fordi der findes et helt system omkring scanneren. Industrien bygger den efter strenge standarder, myndigheder certificerer den, og specialuddannet personale kalibrerer og betjener den. Ansvaret for værktøjets pålidelighed er fordelt på tværs af et helt økosystem.

AI skal behandles på samme måde. For at læger kan bruge AI-baseret indsigt, skal der være organisatoriske mekanismer, der sikrer systemets kvalitet, håndterer risici og garanterer dets korrekte funktion. Det kræver et tværfagligt samarbejde mellem udviklere, læger, hospitalsadministratorer og lovgivere for at identificere den bedste måde at integrere teknologien i eksisterende arbejdsgange, kommunikationsprotokoller og institutionelle afhængigheder.

Ofte Stillede Spørgsmål (OSS)

Vil AI erstatte min læge?

Det er højst usandsynligt. Den mest lovende og sikre fremtid for AI i medicin er som en partner, der forstærker lægens evner, ikke erstatter dem. AI kan håndtere store mængder data og genkende mønstre, mens lægen kan anvende sin erfaring, empati og holistiske forståelse af patienten til at træffe den endelige beslutning. Ansvaret for din behandling vil fortsat ligge hos et menneske.

Er AI ikke fyldt med bias?

Jo, AI kan være forudindtaget. Hvis et system trænes på data, der afspejler eksisterende uligheder i sundhed, kan AI'en lære og endda forstærke disse bias. Det er netop derfor, at gennemsigtighed, pålidelighed og en menneske-i-centrum-tilgang er så afgørende. Vi skal bygge systemer, der kan granskes, og som aktivt arbejder for at modvirke bias, ikke blot kopiere dem.

Hvem er ansvarlig, hvis en AI-anbefaling fører til en fejl?

Dette er et centralt etisk og juridisk spørgsmål. I en model, hvor AI fuldt ud automatiserer beslutninger, er ansvaret uklart. Men i den foretrukne model, hvor AI fungerer som et støtteværktøj, forbliver ansvaret hos den kliniker, der træffer den endelige beslutning baseret på al tilgængelig information, inklusive AI'ens input. AI bliver blot endnu en kilde til evidens.

Konklusion: Mod en symbiotisk fremtid

Kunstig intelligens har et enormt potentiale til at forbedre diagnostik, personalisere behandlinger og gøre sundhedsvæsenet mere effektivt. Men vejen frem er ikke at forfølge en teknologisk utopi om fuld automatisering, der fjerner den menneskelige ekspert. Tværtimod ligger den sande revolution i at skabe en intelligent symbiose mellem menneske og maskine. Ved at designe pålidelige, gennemsigtige og menneskecentrerede AI-værktøjer kan vi give lægerne superkræfter: evnen til at se mere, forstå dybere og beslutte bedre. Fremtiden for medicin er ikke menneske *versus* maskine, men menneske *med* maskine, der arbejder sammen for det vigtigste mål af alle: patientens velbefindende.

Hvis du vil læse andre artikler, der ligner AI i Medicin: Partner eller Afløser?, kan du besøge kategorien Sundhed.