10/12/1999

Hvad er Hyperscale Datacentre? Den Usynlige Motor Bag Vores Digitale Liv

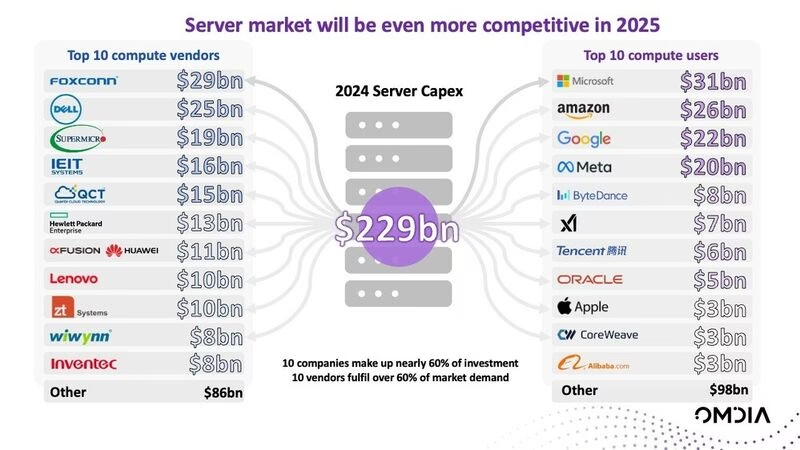

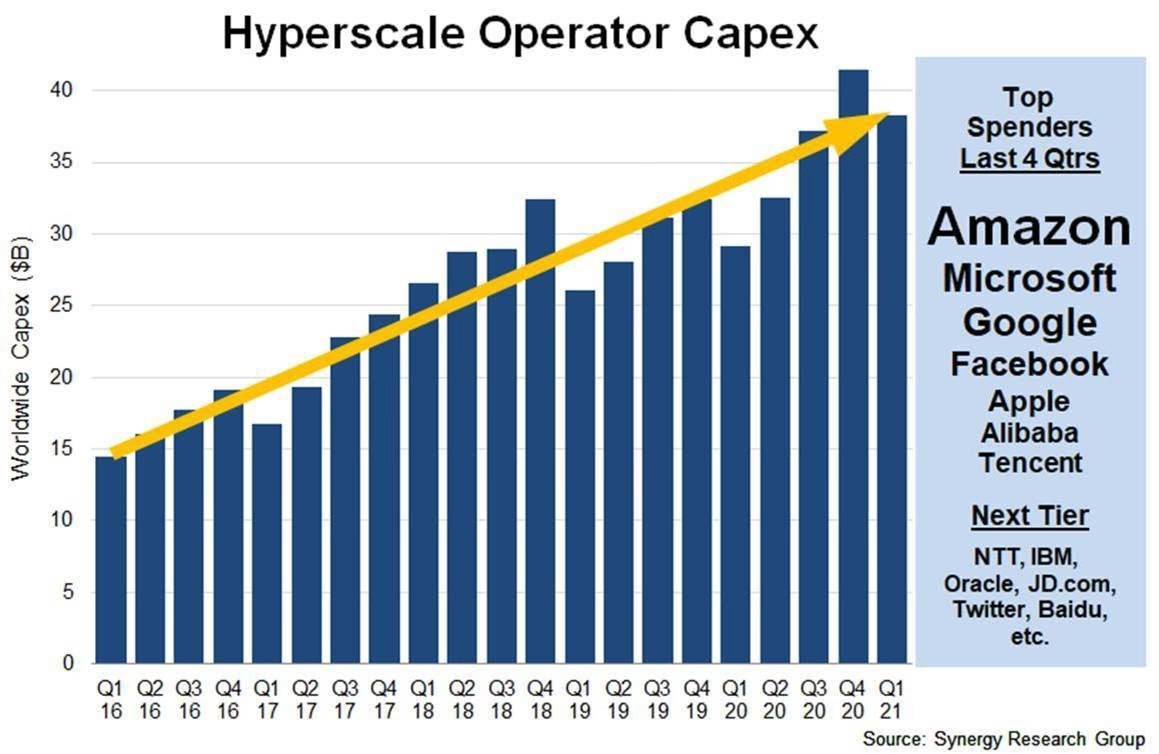

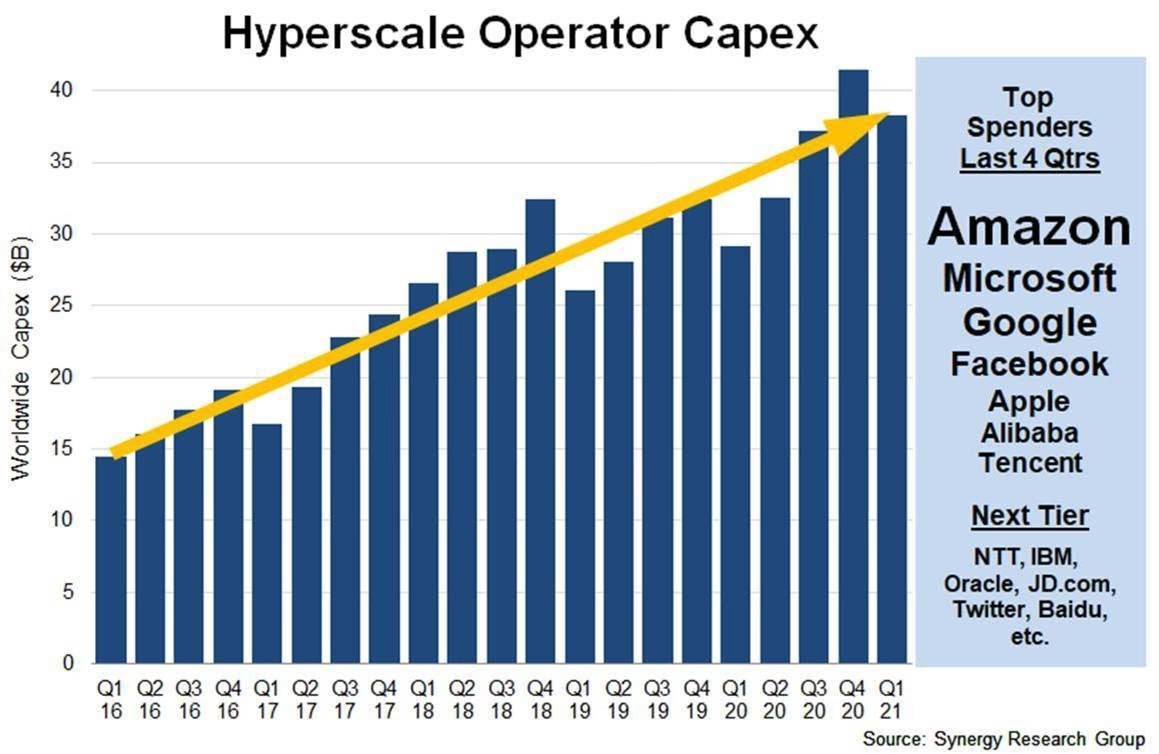

Vores digitale verden er i konstant og eksponentiel vækst. Fra cloud-tjenester og sociale medier til den eksplosive fremkomst af kunstig intelligens (AI), stiger efterspørgslen på databehandling og lagerplads med en hidtil uset hastighed. Bag kulisserne, usynligt for de fleste af os, ligger en infrastrukturrevolution, der gør alt dette muligt: fremkomsten af hyperscale datacentre. For bare et årti siden var størstedelen af verdens datacenterkapacitet placeret i virksomheders egne, lokale serverrum (on-premise). I dag har billedet ændret sig dramatisk. Hyperscale-operatører som Amazon, Google og Microsoft driver nu over 1.000 gigantiske datacentre og står for en stadigt voksende andel af den globale kapacitet. Denne artikel dykker ned i, hvad et hyperscale datacenter er, hvad der adskiller det fra traditionelle datacentre, og hvorfor det er så afgørende for fremtiden.

Hvad Betyder 'Hyperscale' Præcist?

Ordet 'hyperscale' henviser til en computerinfrastrukturs evne til hurtigt og effektivt at skalere for at imødekomme en stigende efterspørgsel. I stedet for at skulle udskifte hele systemer for at få mere kapacitet, er hyperscale-arkitekturen designet til problemfrit at kunne tilføje flere ressourcer – såsom servere, lagerenheder og netværkskomponenter – efter behov. Det er en modulær tilgang, der giver en utrolig fleksibilitet. Tænk på det som at bygge med legoklodser i en gigantisk skala; du kan altid tilføje flere klodser for at bygge noget større og mere komplekst uden at skulle starte forfra.

Disse massive faciliteter er rygraden i de cloud-tjenester, vi bruger hver dag. Virksomheder som Amazon Web Services (AWS), Microsoft Azure og Google Cloud Platform (GCP) bruger hyperscale-databehandling til at tilbyde virksomheder og enkeltpersoner overkommelige, on-demand computerressourcer. Men det er ikke kun cloud-udbydere; store internetvirksomheder som Meta (Facebook, Instagram), Apple og TikTok er også dybt afhængige af deres egne hyperscale datacentre for at kunne levere deres tjenester til milliarder af brugere verden over.

Nøglekarakteristika for et Hyperscale Datacenter

Hyperscale datacentre adskiller sig markant fra traditionelle enterprise datacentre på en række centrale områder. Deres design er optimeret til maksimal effektivitet, skalerbarhed og omkostningsreduktion.

1. Enorm Størrelse og Skalerbarhed

Et af de mest definerende træk er den enorme fysiske størrelse. Et typisk hyperscale datacenter huser titusinder, sommetider hundredtusinder, af servere og kan strække sig over arealer på over 100.000 kvadratmeter. Disse faciliteter er designet med en modulær tilgang, der bruger standardiserede, præfabrikerede komponenter. Dette muliggør hurtig udrulning, udvidelse og forenklet vedligeholdelse, uden at det går ud over ydeevnen. Et enkelt datacenter kan have en strømkapacitet på alt fra 10 til over 100 megawatt (MW) og kan koste over en milliard dollars at bygge.

2. Energieffektivitet og Bæredygtighed

Med en så enorm skala kommer et gigantisk energiforbrug. Hyperscale datacentre er store elforbrugere, og energieffektivitet er derfor en absolut topprioritet – både af økonomiske og miljømæssige årsager. En central måleenhed er PUE (Power Usage Effectiveness), som måler, hvor meget af den samlede energi, der går direkte til IT-udstyret, i forhold til hvor meget der bruges på understøttende systemer som køling. Et perfekt PUE er 1.0. Hyperscale-operatører opnår markant lavere PUE-værdier end gennemsnitlige datacentre.

| Operatør/Type | Gennemsnitlig PUE |

|---|---|

| Google Cloud | 1.10 |

| Meta (Facebook) | 1.08 |

| Microsoft Azure | 1.18 |

| Gennemsnitligt Enterprise Datacenter | 1.58 |

For at opnå denne effektivitet anvendes avancerede kølesystemer (f.eks. væskekøling eller brug af udeluft), energieffektive servere og en stigende brug af vedvarende energikilder. De store tech-giganter er blandt verdens største opkøbere af sol- og vindenergi for at drive deres datacentre og reducere deres CO2-aftryk.

3. Høj Grad af Automatisering

At administrere en infrastruktur af denne størrelse manuelt ville være umuligt. Automatisering er kernen i driften af et hyperscale datacenter. Dette omfatter automatiseret overvågning, vedligeholdelse og tildeling af ressourcer. Kunstig intelligens og machine learning bruges til at forudsige og reagere på potentielle problemer, før de opstår. Teknologier som Software-Defined Networking (SDN) gør det muligt at administrere og konfigurere netværket centralt via software, hvilket giver en utrolig agilitet og effektivitet sammenlignet med traditionelle, manuelt konfigurerede netværk.

4. Omkostningseffektivitet gennem Skala

På trods af de enorme anlægsomkostninger er hyperscale datacentre ekstremt omkostningseffektive i drift. Dette skyldes stordriftsfordele. Operatørerne køber hardware i enorme mængder, hvilket giver dem lavere priser. Mange designer endda deres egne servere og netværksudstyr (f.eks. gennem Open Compute Project), der er skræddersyet til deres specifikke behov, hvilket fjerner unødvendige komponenter og omkostninger. Den høje energieffektivitet og automatisering bidrager yderligere til at holde driftsomkostningerne nede.

Hyperscale vs. Traditionelle Enterprise Datacentre

Forskellen mellem de to typer af datacentre er fundamental. Hvor traditionelle datacentre ofte er bygget til at understøtte en enkelt virksomheds specifikke behov med en blanding af forskelligt udstyr, er hyperscale datacentre bygget på principperne om homogenitet og massiv skala. Her er en hurtig sammenligning:

| Karakteristik | Hyperscale Datacenter | Traditionelt Enterprise Datacenter |

|---|---|---|

| Skala | Titusinder til hundredtusinder af servere | Typisk under 1.000 servere |

| Design | Modulært, standardiseret, homogen hardware | Monolitisk, heterogen hardware fra forskellige leverandører |

| Automatisering | Høj grad af automatisering for drift og administration | Mere manuel administration og vedligeholdelse |

| Effektivitet | Ekstremt høj energieffektivitet (lav PUE) | Lavere effektivitet (højere PUE) |

| Formål | Understøtter massive cloud- og internettjenester | Understøtter en enkelt organisations interne IT-behov |

Udfordringer og Fremtidens Tendenser

Selvom hyperscale datacentre er utroligt effektive, står de også over for betydelige udfordringer. Ressourcemangel, især adgang til jord og store mængder strøm (helst grøn), er en voksende bekymring. Den miljømæssige påvirkning er også under konstant granskning, hvilket driver innovationen inden for bæredygtighed og grøn teknologi endnu hurtigere frem.

Fremtiden for hyperscale datacentre vil sandsynligvis blive formet af flere nøgletrends:

- Edge Computing: For at reducere forsinkelse (latency) for applikationer som IoT og selvkørende biler, flyttes databehandling tættere på brugerne. Hyperscale-infrastrukturen vil fungere som den centrale kerne, der understøtter et netværk af mindre 'edge' datacentre.

- Grøn Teknologi: Fokus på 100% vedvarende energi, mere effektiv vandkøling og genanvendelse af overskudsvarme vil blive endnu vigtigere for at opnå CO2-neutralitet.

- Kunstig Intelligens (AI): AI-workloads kræver enorm regnekraft, især fra specialiserede processorer som GPU'er. Fremtidens hyperscale datacentre vil være designet specifikt til at håndtere disse ekstremt strømkrævende og komplekse opgaver.

- Global Ekspansion: Efterspørgslen efter digitale tjenester vokser hurtigt i nye markeder, hvilket vil drive en fortsat global udbygning af hyperscale-infrastruktur.

Ofte Stillede Spørgsmål (FAQ)

Hvad er de største fordele ved hyperscale datacentre?

De primære fordele er enorm skalerbarhed, høj effektivitet og lavere omkostninger pr. beregningsenhed. De kan hurtigt tilpasse sig svingende efterspørgsel, udnytter automatisering til at optimere driften og opnår lavere omkostninger gennem stordriftsfordele.

Hvordan sikrer hyperscale datacentre høj oppetid og pålidelighed?

De opnår høj pålidelighed gennem massiv redundans. Alt fra strømforsyninger og netværksforbindelser til hele serverracks er duplikeret. Deres distribuerede arkitektur betyder, at hvis en komponent eller endda et helt datacenter fejler, kan arbejdsbyrden automatisk og problemfrit flyttes til en anden lokation, hvilket sikrer kontinuerlig service.

Hvilken rolle spiller AI i driften af disse datacentre?

AI er afgørende for at optimere driften. Den bruges til at styre arbejdsbelastninger, forudsige hardwarefejl (prædiktiv vedligeholdelse), finjustere strømforbrug og kølesystemer i realtid og forbedre sikkerheden ved at opdage trusler hurtigere end mennesker kan.

Er hyperscale datacentre sikre?

Sikkerhed er en topprioritet. De implementerer en flerlags sikkerhedsmodel, der omfatter streng fysisk sikkerhed (biometri, overvågning, vagter), avanceret netværkssikkerhed (firewalls, DDoS-beskyttelse) og stærk datakryptering, både når data er lagret og under overførsel.

Hvis du vil læse andre artikler, der ligner Hyperscale Datacentre: En Dybdegående Guide, kan du besøge kategorien Teknologi.