27/06/2004

I den stadigt voksende verden af kunstig intelligens og maskinlæring er der visse værktøjer, der skiller sig ud på grund af deres enkelhed, kraft og gennemsigtighed. Et af disse fundamentale værktøjer er beslutningstræet. Et beslutningstræ hjælper os med at træffe beslutninger ved at kortlægge forskellige valg og deres mulige resultater på en måde, der minder om et rigtigt træs grene. Det bruges i maskinlæring til opgaver som klassifikation og forudsigelse, og dets intuitive natur gør det til en favorit blandt både dataforskere og forretningsanalytikere. I denne artikel vil vi dykke ned i, hvad et beslutningstræ er, hvordan det fungerer, dets forskellige typer og dets mange anvendelsesmuligheder.

Hvad er et Beslutningstræ?

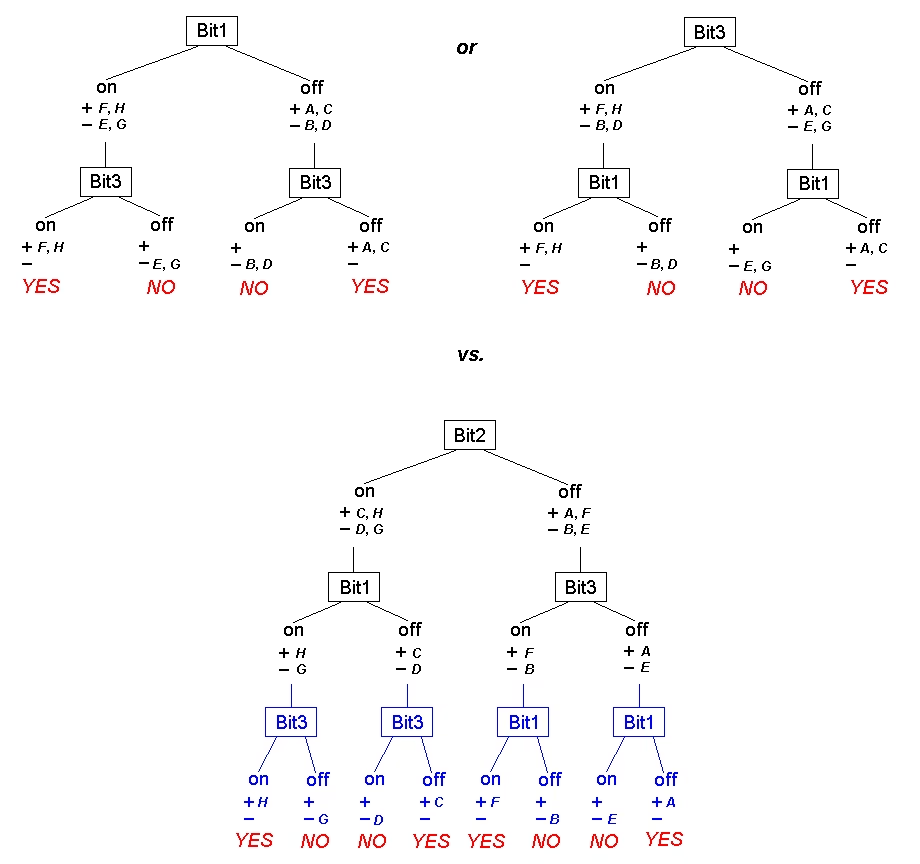

Et beslutningstræ er en model, der visuelt og logisk repræsenterer beslutninger og deres potentielle konsekvenser. Det har en hierarkisk, trælignende struktur, der starter med et enkelt hovedspørgsmål og forgrener sig ud i yderligere spørgsmål baseret på svarene. Hver gren repræsenterer et valg, og hver endeknude (et blad) repræsenterer et resultat.

For at forstå strukturen fuldt ud, er det vigtigt at kende dens kernekomponenter:

- Rodknude (Root Node): Dette er startpunktet for træet og repræsenterer hele datasættet. Her stilles det første og mest afgørende spørgsmål for at opdele dataene.

- Grene (Branches): Disse er linjerne, der forbinder knuderne. Hver gren repræsenterer resultatet af en test (f.eks. 'ja' eller 'nej') og viser vejen fra et spørgsmål til det næste.

- Interne Knuder (Internal Nodes): Disse er punkter i træet, hvor der træffes en beslutning baseret på en bestemt egenskab i dataene. Hver intern knude har grene, der fører til andre interne knuder eller til bladknuder.

- Bladknuder (Leaf Nodes): Disse er endepunkterne i træet. En bladknude repræsenterer den endelige beslutning eller forudsigelse. Når du når en bladknude, er der ikke flere spørgsmål at stille.

Typer af Beslutningstræer

Beslutningstræer kan hovedsageligt opdeles i to typer, baseret på den type variabel, de forsøger at forudsige:

1. Klassifikationstræer (Classification Trees)

Disse bruges, når outputvariablen er kategorisk, det vil sige, den tilhører en af flere foruddefinerede klasser. Målet er at klassificere en ny observation i den korrekte kategori. For eksempel kan et klassifikationstræ bruges til at afgøre, om en e-mail er 'spam' eller 'ikke spam', eller til at diagnosticere, om en patient har en bestemt sygdom eller ej.

2. Regressionstræer (Regression Trees)

Disse bruges, når outputvariablen er kontinuerlig, det vil sige, den kan have en hvilken som helst numerisk værdi inden for et interval. I stedet for at tildele en klasse, forudsiger et regressionstræ en numerisk værdi. Eksempler inkluderer forudsigelse af huspriser baseret på faktorer som størrelse og beliggenhed, eller forudsigelse af en persons forventede levetid baseret på livsstilsfaktorer.

Her er en hurtig sammenligning:

| Egenskab | Klassifikationstræ | Regressionstræ |

|---|---|---|

| Outputvariabel | Kategorisk (f.eks. Ja/Nej, Rød/Grøn/Blå) | Kontinuerlig (f.eks. pris, temperatur) |

| Formål | At klassificere data i foruddefinerede grupper | At forudsige en numerisk værdi |

| Bladknude-værdi | Klassenavn (f.eks. 'Spam') | Gennemsnitlig numerisk værdi |

| Eksempel | Godkendelse af låneansøgning | Forudsigelse af aktiekurser |

Hvordan Fungerer et Beslutningstræ?

Processen med at bygge og bruge et beslutningstræ er logisk og trinvis. Algoritmen, ofte kaldet rekursiv partitionering, fungerer på følgende måde:

- Start ved Rodknuden: Processen begynder med hele datasættet ved rodknuden.

- Find det Bedste Spørgsmål: Algoritmen analyserer alle funktioner (attributter) i dataene for at finde det spørgsmål, der bedst opdeler dataene i de mest homogene undergrupper. For eksempel, i et medicinsk datasæt, kunne det bedste første spørgsmål være "Er patientens blodsukkerniveau over X?".

- Opdel Dataene: Baseret på svaret på spørgsmålet opdeles datasættet i mindre delmængder. Hver delmængde går ned ad en separat gren.

- Gentag Processen: Denne proces med at finde det bedste spørgsmål og opdele dataene gentages rekursivt for hver ny undergruppe (hver ny intern knude).

- Nå en Bladknude: Opdelingen stopper, når en bestemt betingelse er opfyldt. Det kan være, at alle data i en knude tilhører samme klasse, at der ikke er flere funktioner at opdele på, eller at træet har nået en foruddefineret maksimal dybde. Knuden bliver da en bladknude, som giver den endelige forudsigelse.

Et Simpelt Eksempel: Skal jeg drikke kaffe?

Forestil dig, at vi vil bygge et træ, der beslutter, om vi skal drikke kaffe. Træet kunne starte med at spørge om tidspunktet på dagen:

- Er det morgen?

- Ja: Næste spørgsmål: Er du træt?

- Ja: Drik kaffe.

- Nej: Drik ikke kaffe.

- Nej: Næste spørgsmål: Er det eftermiddag?

- Ja: Næste spørgsmål: Er du træt?

- Ja: Drik kaffe.

- Nej: Drik ikke kaffe.

- Nej (det er aften): Drik ikke kaffe.

- Ja: Næste spørgsmål: Er du træt?

- Ja: Næste spørgsmål: Er du træt?

Dette simple eksempel illustrerer den logiske og hierarkiske beslutningsproces.

Vigtige Koncepter: Opdelingskriterier og Beskæring

To afgørende koncepter for at bygge effektive beslutningstræer er, hvordan man vælger de bedste opdelinger, og hvordan man undgår at gøre træet for komplekst.

Opdelingskriterier

For at finde det "bedste" spørgsmål ved hver knude bruger algoritmerne matematiske mål. De mest almindelige er:

- Gini-urenhed (Gini Impurity): Måler sandsynligheden for at klassificere en tilfældigt valgt prøve forkert, hvis den blev tilfældigt mærket i henhold til fordelingen af klasser i knuden. En lavere Gini-urenhed betyder en mere homogen knude, hvilket er målet.

- Entropi og Informationsgevinst (Entropy and Information Gain): Entropi måler graden af uorden eller usikkerhed i et datasæt. Algoritmen søger at maksimere informationsgevinsten, hvilket er reduktionen i entropi efter en opdeling. En opdeling, der resulterer i den største reduktion i usikkerhed, vælges.

Beskæring (Pruning)

Et beslutningstræ, der er for dybt og komplekst, kan begynde at "huske" træningsdataene i stedet for at lære generelle mønstre. Dette fænomen kaldes overfitting og fører til dårlig ydeevne på nye, usete data. For at forhindre dette bruges en teknik kaldet beskæring.

Beskæring fjerner grene fra træet, der har ringe forudsigelseskraft. Dette simplificerer modellen, gør den hurtigere og hjælper den med at generalisere bedre til nye data. Det er en afgørende del af processen for at bygge robuste og pålidelige beslutningstræer.

Fordele og Ulemper ved Beslutningstræer

Som alle andre maskinlæringsmodeller har beslutningstræer deres styrker og svagheder.

| Fordele | Ulemper |

|---|---|

| Let at forstå og fortolke: Den visuelle, trælignende struktur er meget intuitiv. | Overfitting: Uden beskæring kan de let blive for komplekse og passe dårligt til nye data. |

| Kræver lidt dataforberedelse: De kræver ikke normalisering eller skalering af data. | Instabilitet: Små ændringer i data kan føre til et helt andet træ. |

| Kan håndtere både numeriske og kategoriske data: De er meget alsidige. | Bias mod funktioner med mange niveauer: Træer kan favorisere funktioner med mange kategorier. |

| Håndterer ikke-lineære sammenhænge: De kan fange komplekse mønstre i data. | Kan være beregningsmæssigt dyre: At bygge optimale træer er en NP-svær opgave, selvom heuristikker er hurtige. |

Anvendelser i den Virkelige Verden

Beslutningstræers fortolkelighed og alsidighed gør dem nyttige i en lang række brancher.

- Medicinsk Diagnose: I sundhedssektoren hjælper beslutningstræer med at diagnosticere sygdomme. For eksempel kan en model forudsige, om en patient har diabetes baseret på kliniske data som glukoseniveauer, BMI og blodtryk. Dette hjælper med at klassificere patienter og understøtter tidlig diagnose og behandling.

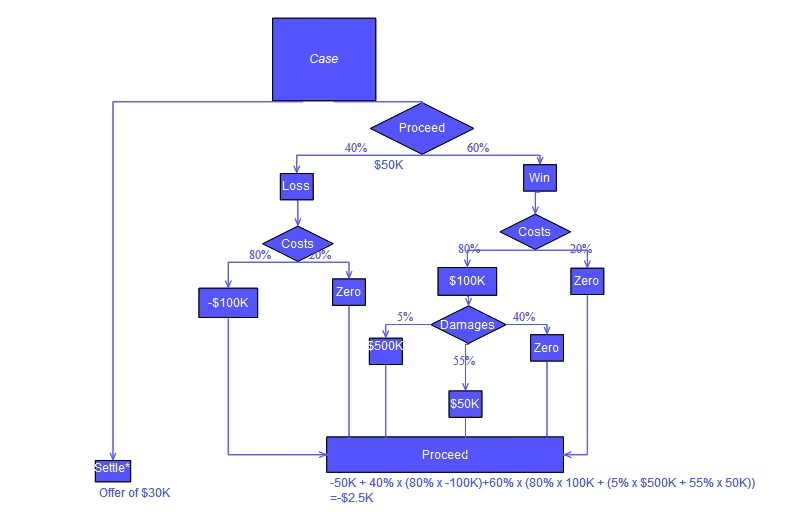

- Bank og Finans: Banker bruger beslutningstræer til at vurdere risiko, f.eks. om en låneansøgning skal godkendes. Modellen analyserer faktorer som kreditvurdering, indkomst og ansættelsesstatus for at forudsige sandsynligheden for misligholdelse. De bruges også til at opdage svigagtige transaktioner.

- Kundefrafaldsforudsigelse: Virksomheder bruger træer til at forudsige, hvilke kunder der er i fare for at forlade dem. Ved at analysere kundeadfærd, købshistorik og interaktioner kan virksomheder proaktivt tage skridt til at fastholde værdifulde kunder.

- Uddannelse: Institutioner kan forudsige, om en studerende vil bestå eller dumpe en eksamen baseret på faktorer som fremmøde, studietid og tidligere karakterer. Dette hjælper lærere med at identificere risikostuderende og tilbyde målrettet støtte.

Ud over det Grundlæggende: Ensemble-metoder

Selvom et enkelt beslutningstræ kan være nyttigt, ligger deres sande styrke ofte i at kombinere mange af dem. Dette kaldes ensemble-metoder.

- Random Forests: Denne metode bygger et stort antal beslutningstræer på tilfældige delmængder af data og funktioner. Den endelige forudsigelse er gennemsnittet (for regression) eller den mest hyppige klasse (for klassifikation) af alle træernes forudsigelser. Dette reducerer overfitting markant og forbedrer nøjagtigheden.

- Gradient Boosting: Metoder som XGBoost og LightGBM bygger træer sekventielt, hvor hvert nyt træ forsøger at rette op på fejlene fra de foregående træer. Disse modeller er ofte blandt de mest præsterende på tabeldata og vinder jævnligt maskinlæringskonkurrencer.

Ofte Stillede Spørgsmål (FAQ)

Er beslutningstræer altid den bedste model at bruge?

Nej, den bedste model afhænger altid af problemet og dataene. Beslutningstræer og deres ensembler (som Random Forests og XGBoost) er ekstremt effektive til strukturerede eller tabeldata. For ustrukturerede data som billeder eller lyd er dybe neurale netværk ofte et bedre valg.

Hvad er den største ulempe ved et enkelt beslutningstræ?

Den største ulempe er deres tendens til overfitting. Et enkelt træ kan blive meget komplekst for at passe perfekt til træningsdataene, hvilket gør det dårligt til at generalisere til nye data. Dette er grunden til, at teknikker som beskæring og brugen af ensemble-metoder er så vigtige.

Hvorfor er beslutningstræer betragtet som 'hvid boks'-modeller?

De kaldes 'hvid boks' (white-box) modeller, fordi deres interne logik er let at inspicere og forstå. Man kan følge beslutningsstien fra rod til blad for enhver given forudsigelse, hvilket gør dem meget gennemsigtige i modsætning til 'sort boks' (black-box) modeller som neurale netværk, hvor det kan være meget svært at forstå, hvorfor en bestemt beslutning blev truffet.

Konklusion

Beslutningstræer er et fundamentalt, men utroligt kraftfuldt værktøj inden for maskinlæring. Deres evne til at omdanne komplekse data til en simpel, fortolkelig og visuel model gør dem uvurderlige i mange forskellige domæner. Fra at forbedre patientdiagnoser til at optimere forretningsbeslutninger fortsætter beslutningstræer og deres mere avancerede slægtninge, som Random Forests, med at drive innovation og levere indsigt i en datadrevet verden. Ved at mestre dette værktøj kan man få en dybere forståelse af data og træffe mere informerede beslutninger på tværs af forskellige felter.

Hvis du vil læse andre artikler, der ligner Beslutningstræer i Maskinlæring Forklaret, kan du besøge kategorien Teknologi.