28/07/2015

- Introduktion til Behandling af Store Sundhedsdata

- Hvad er Parallel Databehandling i Sundhedsvæsenet?

- Metoder til at Fremskynde Analyse af Patientdata

- Specialiserede Værktøjer: Digitale 'Speciallæger' til Dataanalyse

- Udfordringer og Løsninger ved Parallel Behandling

- Sammenligning: Sekventiel vs. Parallel Databehandling

- Ofte Stillede Spørgsmål (OSS)

- Konklusion

Introduktion til Behandling af Store Sundhedsdata

I den moderne sundhedssektor genereres der hver dag en ufattelig mængde data. Fra elektroniske patientjournaler og medicinske scanninger til genomsekventering og data fra bærbare sundhedsenheder, er informationsmængden eksploderet. For læger, forskere og hospitaler udgør denne enorme datamængde både en guldgrube af viden og en betydelig teknisk udfordring. At analysere disse store datasæt kan være en langsommelig proces, og denne ventetid kan i sidste ende være en flaskehals for medicinske gennembrud og forbedret patientpleje. En af de mest effektive løsninger på denne udfordring er at parallelisere kode, hvilket betyder at opdele en stor opgave i mindre bidder, der kan udføres samtidigt. Dette er ikke blot en teknisk øvelse for dataforskere; det er en metode, der har potentialet til at revolutionere hastigheden, hvormed vi opnår medicinsk indsigt.

Hvad er Parallel Databehandling i Sundhedsvæsenet?

Parallel databehandling kan bedst forklares med en analogi fra hospitalsverdenen. Forestil dig, at en enkelt læge skal gennemgå en meget omfattende patientjournal med tusindvis af sider. Det ville tage lang tid. Forestil dig nu i stedet, at et team af fem læger får hver deres del af journalen at gennemgå på samme tid. De kan fuldføre opgaven på en brøkdel af tiden. Dette er essensen af parallel behandling: en stor opgave (gennemgang af hele journalen) opdeles i mindre, uafhængige delopgaver (gennemgang af sektioner), som udføres samtidigt af flere processorer (lægerne).

I konteksten af databehandling betyder det, at en computer med flere processorkerner kan arbejde på forskellige dele af et datasæt på én gang. For et hospital, der analyserer genetiske data fra tusindvis af patienter for at finde markører for en bestemt sygdom, kan denne tilgang reducere analysetiden fra uger til timer. Det er dog vigtigt at bemærke, at ikke alle opgaver kan paralleliseres. Nogle analyser kræver, at trinene udføres i en bestemt rækkefølge, ligesom en kirurgisk procedure, hvor et skridt er afhængigt af det foregående.

Metoder til at Fremskynde Analyse af Patientdata

Der findes flere strategier til at implementere parallel behandling af sundhedsdata. Selvom de tekniske detaljer involverer specifikke programmeringsbiblioteker, kan principperne forstås af alle med interesse for sundhedsteknologi.

Metode 1: Anvendelse af en Funktion på Hver Patient Samtidigt

En almindelig opgave er at anvende en bestemt analyse eller funktion på hver enkelt patient i et stort datasæt. Det kan for eksempel være at beregne en risikoscore for hjertesygdomme baseret på blodtryk, kolesterol og andre faktorer. I en traditionel (sekventiel) tilgang ville computeren behandle patient nummer ét, derefter patient nummer to, og så videre. Med parallel behandling kan man instruere computeren i at anvende funktionen på hundredvis eller tusindvis af patienter samtidigt, hvor hver processorkerne tager sig af en patient. Resultaterne samles derefter, når alle er færdige. Dette er ekstremt effektivt for opgaver, hvor analysen af én patient ikke afhænger af resultaterne fra en anden.

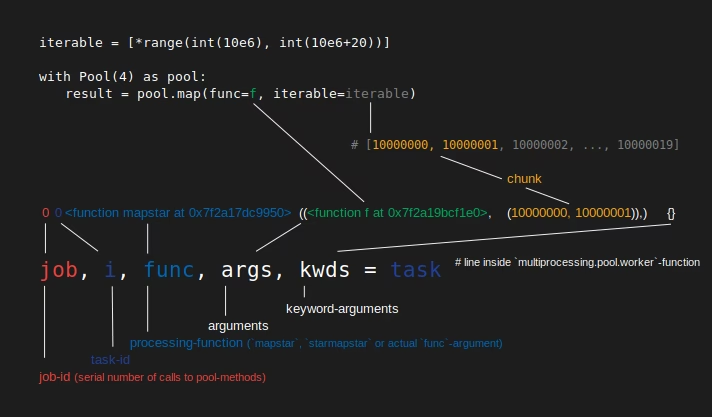

Metode 2: Læsning af Massive Datafiler i Mindre "Bidder"

Nogle gange er selve datafilen, f.eks. fra et nationalt sundhedsregister, så stor, at den ikke kan indlæses i computerens hukommelse på én gang. Her er en smart løsning at læse filen i mindre, håndterbare "bidder" (chunks). En computer kan for eksempel indlæse de første 100.000 patientjournaler, sende dem til en processorkerne til analyse, og mens den arbejder, kan den næste bid af 100.000 journaler indlæses og sendes til en anden kerne. Denne metode sikrer en kontinuerlig strøm af arbejde og forhindrer systemnedbrud på grund af overbelastet hukommelse. Det er en robust måde at håndtere de enorme mængder patientdata, som moderne medicinsk forskning bygger på.

Specialiserede Værktøjer: Digitale 'Speciallæger' til Dataanalyse

Ligesom sundhedsvæsenet har speciallæger til komplekse sygdomme, findes der i dataverdenen specialiserede softwarebiblioteker, der er bygget til at håndtere parallel behandling. Et eksempel er et værktøj som Dask. Man kan tænke på Dask som en digital 'overlæge', der automatisk koordinerer opdelingen af et stort datasæt, fordeler arbejdet til de forskellige 'læger' (processorkerner) og samler resultaterne til en samlet konklusion. Disse værktøjer gør det meget lettere for dataforskere på hospitaler og i medicinalvirksomheder at udføre kompleks sundhedsanalyse uden at skulle bygge hele det parallelle system fra bunden. De håndterer logistikken, så forskerne kan fokusere på det medicinske indhold.

Udfordringer og Løsninger ved Parallel Behandling

Selvom fordelene er store, er der også udfordringer, der skal håndteres omhyggeligt, især når man arbejder med følsomme sundhedsdata.

- Datasikkerhed og integritet: Når flere processer tilgår data samtidigt, er der en teoretisk risiko for, at de 'forstyrrer' hinanden og skaber fejl i dataene. Dette svarer til, at to læger skriver i den samme papirjournal på samme tid og gør teksten ulæselig. Løsningen er at bruge 'låsemekanismer' eller sikre, at processerne kun læser data eller arbejder på separate kopier, så originaldata forbliver intakte.

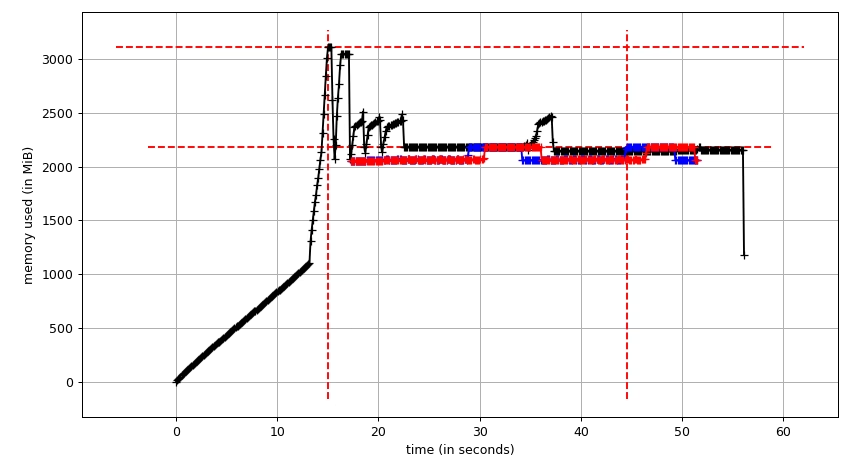

- Ressourceforbrug: Parallel behandling kan være krævende for en computers hukommelse og processorkraft. Det er vigtigt at overvåge ressourcerne nøje og bruge teknikker som behandling i bidder for at undgå overbelastning.

- Opgaveafhængighed: Som nævnt kan ikke alt paralleliseres. En analyse af, hvordan en bestemt behandling påvirker en patients blodtryk over tid, er i sagens natur sekventiel. Man er nødt til at kende blodtrykket fra dag ét, før man kan analysere effekten på dag to. At forsøge at parallelisere en sådan opgave kan føre til en forkert diagnose eller forkerte konklusioner.

Sammenligning: Sekventiel vs. Parallel Databehandling

| Egenskab | Sekventiel Behandling (Én læge) | Parallel Behandling (Et team af læger) |

|---|---|---|

| Hastighed | Langsom, især ved store datasæt. | Meget hurtig, da arbejdet fordeles. |

| Ressourcebrug | Lavere brug af CPU på et givent tidspunkt, men kan kræve meget hukommelse, hvis hele datasættet indlæses. | Højere brug af CPU, da alle kerner er aktive. Hukommelsesforbruget kan styres med "bidder". |

| Kompleksitet | Simpel at implementere og forstå. | Mere kompleks at opsætte og styre korrekt. |

| Ideel til | Små datasæt eller opgaver med trin, der er afhængige af hinanden. | Store datasæt og opgaver, der kan opdeles i uafhængige delopgaver (f.eks. billedanalyse, genetisk screening). |

Ofte Stillede Spørgsmål (OSS)

Er det sikkert at behandle følsomme patientdata på denne måde?

Ja, absolut. Metoden for databehandling er adskilt fra sikkerhedsprotokollerne. Så længe hospitalet eller forskningsinstitutionen overholder gældende lovgivning som GDPR, bruger stærk kryptering, dataanonymisering og har styr på adgangskontrol, er parallel behandling lige så sikker som enhver anden form for databehandling.

Kan alle medicinske dataanalyser gøres hurtigere med parallelisering?

Nej, ikke alle. Som tidligere nævnt er metoden bedst egnet til opgaver, der kan deles op i uafhængige bidder. En opgave som at følge en enkelt patients sygdomsudvikling over mange år er sekventiel af natur og vil ikke have gavn af parallelisering. Derimod er screening af 10.000 mammografibilleder for tegn på kræft en perfekt opgave for parallel behandling, da hvert billede kan analyseres uafhængigt af de andre.

Hvilken betydning har dette for den almindelige patient?

For patienten kan fordelene være meget konkrete. Hurtigere analyse af genetiske data kan føre til hurtigere diagnoser for sjældne sygdomme. Forskere kan hurtigere identificere mønstre i store befolkningsgrupper, hvilket kan accelerere udviklingen af nye lægemidler og behandlinger. I sidste ende betyder hurtigere dataanalyse, at vejen fra forskning til forbedret patientbehandling bliver kortere, hvilket kan føre til bedre sundhedsresultater for alle.

Konklusion

Behandling af store mængder sundhedsdata er en af de centrale udfordringer og muligheder i moderne medicin. Parallel databehandling er ikke længere en nicheteknologi, men et essentielt værktøj for hospitaler, medicinalindustrien og forskningsinstitutioner verden over. Ved at opdele massive opgaver i mindre, håndterbare bidder, der kan løses samtidigt, kan vi dramatisk reducere den tid, det tager at omsætte data til værdifuld viden. Selvom der er tekniske udfordringer, der skal håndteres med omhu, er potentialet for at fremskynde medicinske gennembrud, personalisere medicin og i sidste ende redde liv enormt. Det er en teknologisk revolution, der sker i kulissen, men som vil få stor betydning for patientbehandlingen i frontlinjen.

Hvis du vil læse andre artikler, der ligner Sundhedsdata: Hurtigere analyse med parallelisering, kan du besøge kategorien Sundhed.