14/01/2004

Forestil dig, at du analyserer de daglige indlæggelsestal på et hospital over flere måneder. Du bemærker, at når antallet af indlæggelser er højt en dag, er det ofte også højt den følgende dag. Dette mønster indikerer en sammenhæng mellem på hinanden følgende værdier i datasættet – et fænomen kendt som autokorrelation. Tilsvarende, hvis man ser på data for influenzasæsoner over 10 år, kan man finde mønstre i hyppigheden af høje smittetal, hvilket tyder på, at tidligere forekomster påvirker fremtidige. Disse eksempler fremhæver, hvordan autokorrelation hjælper med at afdække de underliggende mønstre i tidsrækker.

Autokorrelation er et fundamentalt koncept inden for tidsrækkeanalyse, som anvendes bredt inden for områder som epidemiologi, hospitalsledelse og medicinsk forskning. Det måler forholdet mellem en variabels nuværende værdi og dens tidligere værdier over successive tidsintervaller. Ved at forstå dette kan vi skabe mere præcise prognoser, forbedre ressourceallokering og i sidste ende levere bedre patientpleje. Denne artikel udforsker autokorrelation, dens betydning og relaterede koncepter, så du kan anvende det til at forstå sundhedsdata bedre.

Forståelse af Autokorrelation

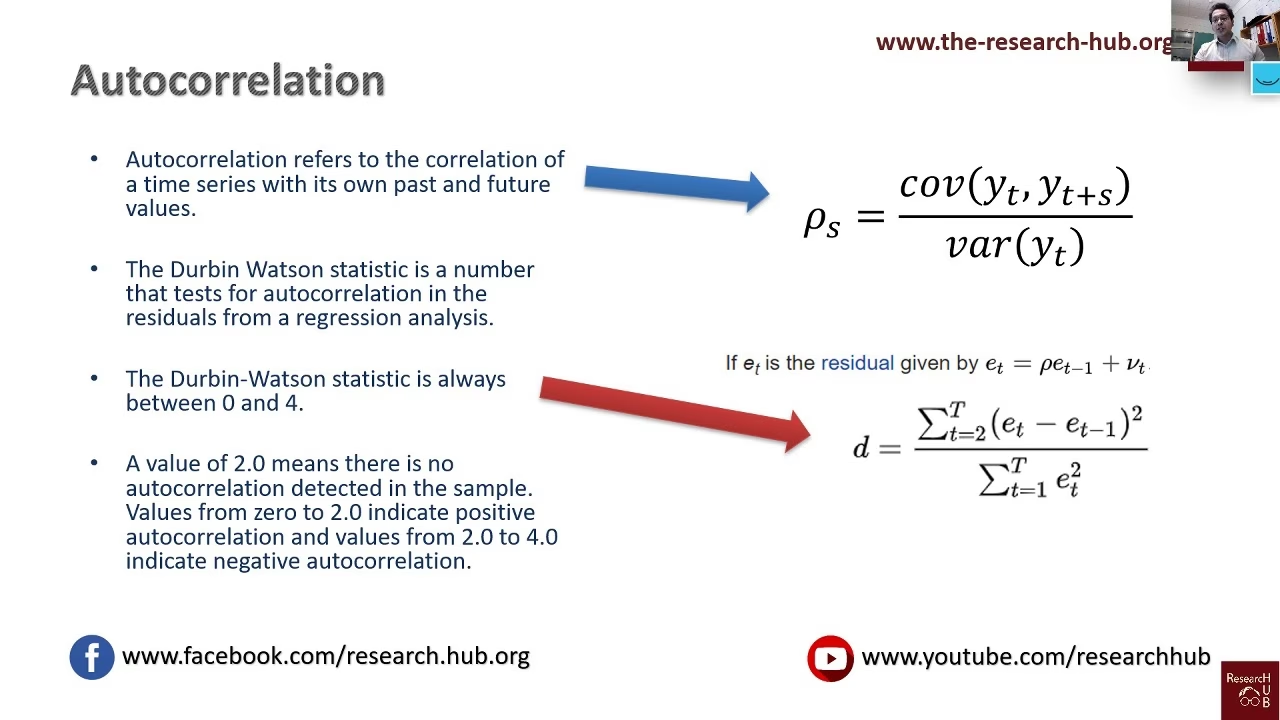

Autokorrelation, også kendt som seriel korrelation, kvantificerer ligheden mellem observationer i en tidsrække på forskellige tidspunkter (eller 'lags'). I modsætning til standard korrelation, som måler forholdet mellem to separate variabler, fokuserer autokorrelation på den samme variabel på tværs af forskellige tidsperioder.

Kendetegn ved Autokorrelation

- Positiv Autokorrelation: Når høje værdier efterfølges af høje værdier (eller lave af lave). Eksempel: En travl dag på skadestuen efterfølges ofte af endnu en travl dag.

- Negativ Autokorrelation: Når høje værdier efterfølges af lave værdier (og omvendt). Eksempel: Efter en stor offentlig vaccinationskampagne kan antallet af nye sygdomstilfælde falde markant, for derefter at stige en smule igen, når kampagnens effekt aftager.

- Nul Autokorrelation: Indikerer, at der ikke er nogen sammenhæng mellem nuværende og tidligere værdier. Observationerne er uafhængige af hinanden.

Hvad er Partiel Autokorrelation?

Mens autokorrelation måler den samlede sammenhæng mellem en observation og dens tidligere værdier, isolerer partiel autokorrelation det direkte forhold. Den fjerner effekten af de mellemliggende 'lags'. For eksempel måler den partielle autokorrelation ved lag 3 korrelationen mellem dagens værdi og værdien for tre dage siden, eksklusive enhver indflydelse fra lag 1 og 2.

Partiel autokorrelation er afgørende for at bestemme ordenen af autoregressive (AR) termer i mere komplekse prognosemodeller som ARIMA. Ved at se på et plot af den partielle autokorrelationsfunktion (PACF), kan analytikere identificere de mest signifikante direkte sammenhænge og bygge en mere præcis model.

Autokorrelation vs. Partiel Autokorrelation: En Sammenligning

Både autokorrelation (ACF) og partiel autokorrelation (PACF) er uundværlige værktøjer, men de tjener forskellige formål. At forstå forskellen er nøglen til korrekt modelbygning i tidsrækkeanalyse.

| Funktion | Autokorrelationsfunktion (ACF) | Partiel Autokorrelationsfunktion (PACF) |

|---|---|---|

| Formål | Måler den samlede (direkte og indirekte) korrelation mellem en observation og dens forsinkede værdier. | Måler den direkte korrelation mellem en observation og dens forsinkede værdier efter at have fjernet effekten af kortere lags. |

| Anvendelse | Nyttig til at identificere mønstre som trends og sæsonudsving. Bruges til at bestemme ordenen af Moving Average (MA) modeller. | Afgørende for at identificere ordenen af Autoregressive (AR) modeller. Viser, hvilke lags der har en direkte prædiktiv værdi. |

| Fortolkning | Værdier aftager typisk gradvist. Et langsomt fald indikerer en stærk trend. | Værdier "afskæres" ofte brat efter et bestemt lag, hvilket indikerer ordenen af AR-modellen. |

Sådan Opdager og Tester du for Autokorrelation

Før man kan håndtere autokorrelation, skal man først opdage den. Den mest almindelige metode er visuel inspektion af et autokorrelationsplot (ACF-plot), som viser korrelationen for forskellige lags. Hvis søjlerne i plottet overstiger et signifikansniveau (typisk vist som et skraveret område), er der bevis for autokorrelation.

For en mere formel tilgang kan man bruge statistiske tests. En af de mest kendte er Durbin-Watson-testen. Denne test bruges specifikt til at opdage autokorrelation i residualerne (fejlene) fra en regressionsanalyse. Det er vigtigt, fordi autokorrelation i residualerne kan føre til upålidelige konklusioner om modellens effektivitet.

Fortolkning af Durbin-Watson Værdier

- DW ≈ 2: Ingen autokorrelation. Residualerne er uafhængige, hvilket er det ideelle scenarie.

- DW < 2: Positiv autokorrelation. Dette er den mest almindelige form for autokorrelation i tidsrækker.

- DW > 2: Negativ autokorrelation.

Metoder til Håndtering af Autokorrelation i Sundhedsdata

Når autokorrelation er til stede i dine data, kan det forvride modellens nøjagtighed og føre til forkerte konklusioner. Heldigvis findes der flere strategier til at håndtere det, hvilket resulterer i mere pålidelige statistiske modeller og prognoser.

1. Forbedre Modelspecifikationen

Ofte skyldes autokorrelation, at modellen mangler vigtige forklarende variabler. Ved at tilføje relevante variabler kan man fange de underliggende mønstre, som forårsager korrelationen.

Eksempel: Hvis man analyserer månedlige astmaanfald, og der er stærk autokorrelation, kan det skyldes sæsonudsving. Ved at tilføje variabler for pollental eller årstider kan modellen bedre redegøre for udsvingene, hvilket reducerer autokorrelationen i residualerne.

2. Brug Autoregressive Modeller

Modeller som AR (Autoregressive), MA (Moving Average) eller ARIMA (Autoregressive Integrated Moving Average) er designet specifikt til at håndtere autokorrelation. De inkorporerer eksplicit tidligere værdier eller tidligere fejl i prognoseprocessen.

Eksempel: Ved forudsigelse af antallet af patienter på en skadestue kan en ARIMA-model bruge data fra de seneste dage til at forudsige antallet i morgen. Dette fanger den tidsmæssige afhængighed direkte i modellen.

3. Anvend Transformationer

Datatransformationer kan hjælpe med at stabilisere variansen eller fjerne trends, hvilket gør dataene mere stationære og reducerer autokorrelation. En almindelig teknik er 'differencing', hvor man analyserer forskellen mellem på hinanden følgende observationer i stedet for de rå værdier.

Eksempel: Hvis data for hospitalsindlæggelser viser en konstant stigende tendens over tid, kan man ved at beregne forskellen fra den ene måned til den næste fjerne trenden og gøre det lettere at modellere de underliggende udsving.

4. Inkluder Forsinkede Variabler (Lagged Variables)

En simpel, men effektiv metode er at tilføje forsinkede versioner af den afhængige variabel som prædiktorer i en regressionsmodel. Dette hjælper med at fange de tidsmæssige afhængigheder og reducere autokorrelation i residualerne.

Eksempel: For at forudsige dagens antal patienter med influenza kan man inkludere antallet af patienter fra i går og i forgårs som uafhængige variabler i modellen.

Konklusion

Autokorrelation er et kraftfuldt koncept, der afslører mønstre og afhængigheder over tid i sundhedsdata. Ved at måle korrelationen af en tidsrække med sine egne tidligere værdier kan analytikere identificere trends, cykliske adfærd og sæsonudsving. Anvendelsen af disse indsigter er afgørende for at forbedre nøjagtigheden af prognosemodeller og træffe bedre, datadrevne beslutninger inden for ressourcestyring, sygdomsovervågning og patientpleje. At forstå og håndtere autokorrelation er derfor en vital færdighed i moderne sundhedsanalyse.

Ofte Stillede Spørgsmål

Hvad er hovedformålet med autokorrelation i analyse af sundhedsdata?

Hovedformålet er at identificere mønstre, trends og tidsmæssige afhængigheder i data. Dette hjælper med at forudsige fremtidige hændelser, såsom patientindlæggelser eller sygdomsudbrud, og forbedre planlægningen.

Hvordan påvirker autokorrelation prædiktive modeller?

Hvis den ikke håndteres, kan autokorrelation krænke antagelserne i mange statistiske modeller (som f.eks. lineær regression). Dette kan føre til upræcise estimater, forkerte konklusioner om variables signifikans og generelt mindre pålidelige prognoser.

Hvad er forskellen mellem autokorrelation og partiel autokorrelation?

Autokorrelation måler den samlede korrelation mellem observationer på tværs af et tidsinterval, inklusive både direkte og indirekte effekter. Partiel autokorrelation isolerer den direkte effekt ved at fjerne indflydelsen fra mellemliggende observationer.

Hvordan kan jeg teste for autokorrelation i mit hospitals data?

Du kan bruge visuelle værktøjer som et ACF-plot til at se, om korrelationerne er signifikante. For en mere formel test kan du anvende en statistisk test som Durbin-Watson-testen på residualerne fra din prognosemodel.

Hvis du vil læse andre artikler, der ligner Autokorrelation i Sundhedsdata: Forstå Mønstre, kan du besøge kategorien Sundhed.