02/08/2012

I en verden, hvor software bliver mere og mere abstrakt, er der én fundamental ting, der forbliver uændret: betydningen af floating-point aritmetik. Enhver computerprogrammør vil på et tidspunkt arbejde med tal – det er trods alt derfor, de kaldes computere. Derfor er det utroligt nyttigt at forstå, hvordan maskiner udfører matematik, uanset om din kode er til en simpel to-do-app, en avanceret børsplatform eller et intelligent køleskab. Hvordan lagres tal præcist? Hvad er betydningen af specielle værdier som 'Infinity' og 'NaN'? Og hvorfor er 0.1 + 0.2 ikke altid lig med 0.3 i programmeringens verden? Lad os udforske dette komplekse, men fascinerende emne.

Grundlaget: Hvad er Floating-Point Tal?

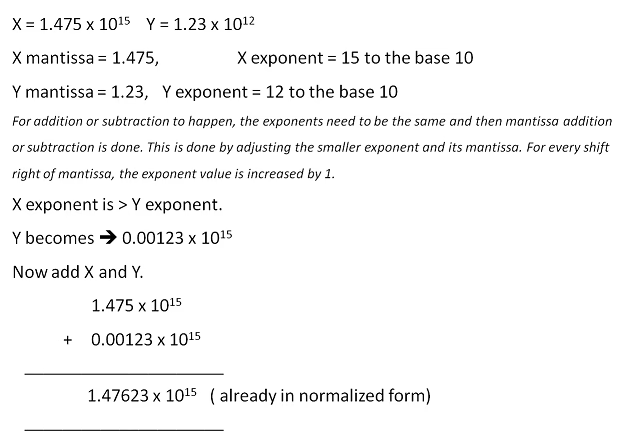

Når vi skal repræsentere meget små eller meget store tal, er en fastpunktsrepræsentation ofte utilstrækkelig. Præcisionen går tabt. Derfor ser vi på floating-point repræsentationer, hvor det binære punkt antages at 'flyde'. Tænk på videnskabelig notation i decimalsystemet, som f.eks. 6.022 × 10²³. Her er '6.022' signifikanden (også kaldet mantissen), og '23' er eksponenten. Dette system tillader os at udtrykke et enormt spænd af tal på en standardiseret måde.

Computere gør noget lignende, men i det binære system (base-2). Et floating-point tal består grundlæggende af tre dele:

- Fortegnsbit (Sign): En enkelt bit, der angiver, om tallet er positivt (0) eller negativt (1).

- Eksponent (Exponent): Et sæt bits, der bestemmer tallets størrelsesorden. Det fungerer som potensen i videnskabelig notation.

- Signifikand (Significand/Mantissa): Et sæt bits, der repræsenterer de faktiske cifre i tallet, altså præcisionen.

Denne struktur gør det muligt for computere at håndtere et bredt spektrum af værdier, fra de mindste subatomare målinger til de største astronomiske afstande, alt sammen inden for en fast bit-længde.

IEEE 754: Standarden, Der Styrer Det Hele

I computerens tidlige dage havde næsten ethvert system sin egen måde at håndtere floating-point tal på. Dette skabte kaos og gjorde det næsten umuligt at portere software mellem forskellige maskiner. For at løse dette problem etablerede Institute of Electrical and Electronics Engineers (IEEE) en standard kendt som IEEE 754. Denne standard blev hurtigt adopteret af industrien og er i dag den universelle måde, hvorpå floating-point aritmetik udføres på næsten alle computere i verden.

Standarden definerer primært to almindelige præcisionsformater:

- Single-Precision (binary32): Bruger 32 bits til at lagre et tal. Dette format er almindeligt kendt som en `float` i mange programmeringssprog. Det består af 1 fortegnsbit, 8 eksponentbits og 23 signifikandbits.

- Double-Precision (binary64): Bruger 64 bits til at lagre et tal. Dette er kendt som en `double`. Det giver meget højere præcision og et større rækkevidde med 1 fortegnsbit, 11 eksponentbits og 52 signifikandbits.

Takket være IEEE 754 kan en udvikler være sikker på, at en beregning som `3.14 * 2.0` vil give det samme binære resultat på en Intel-processor som på en ARM-processor i din smartphone.

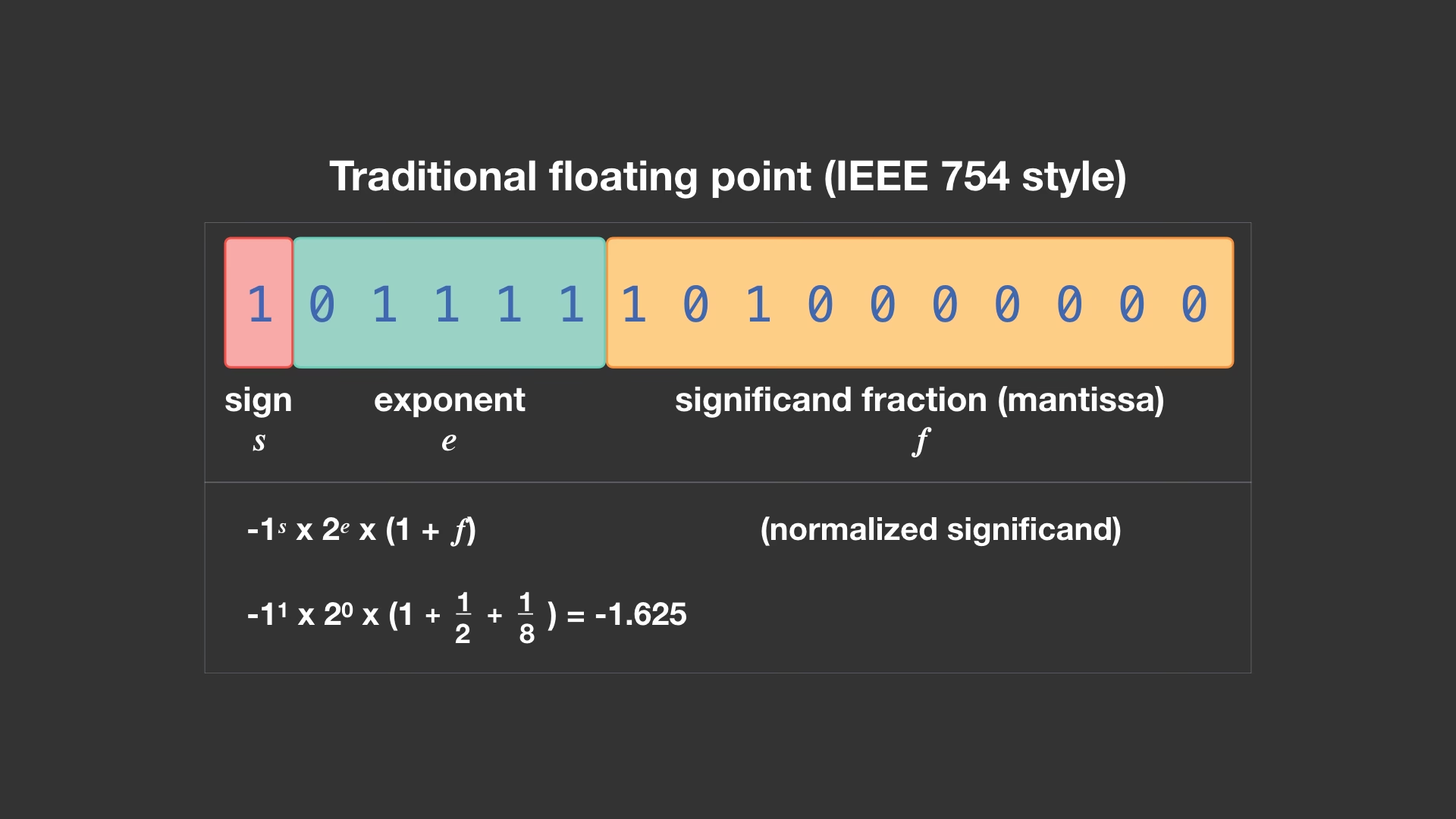

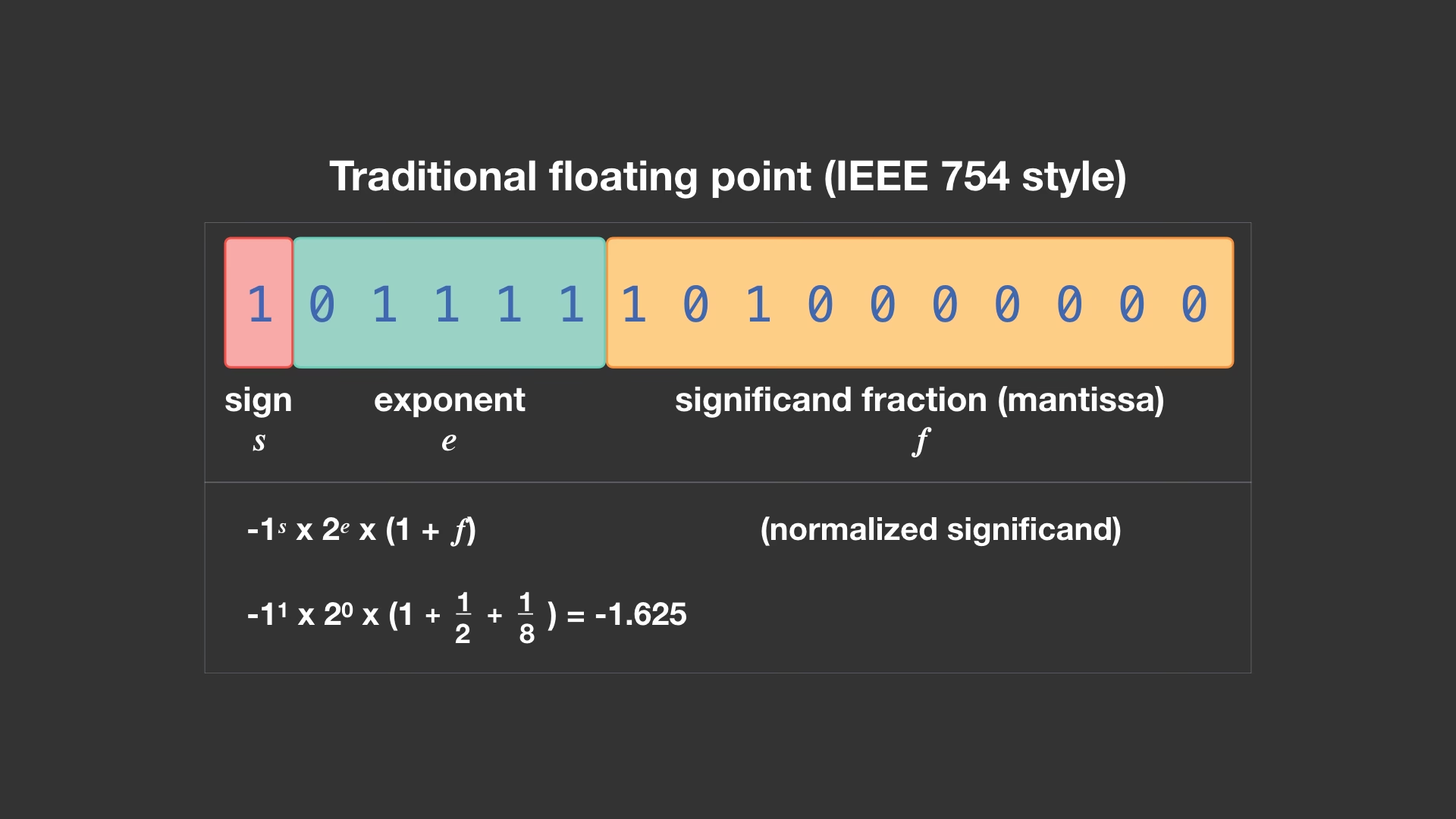

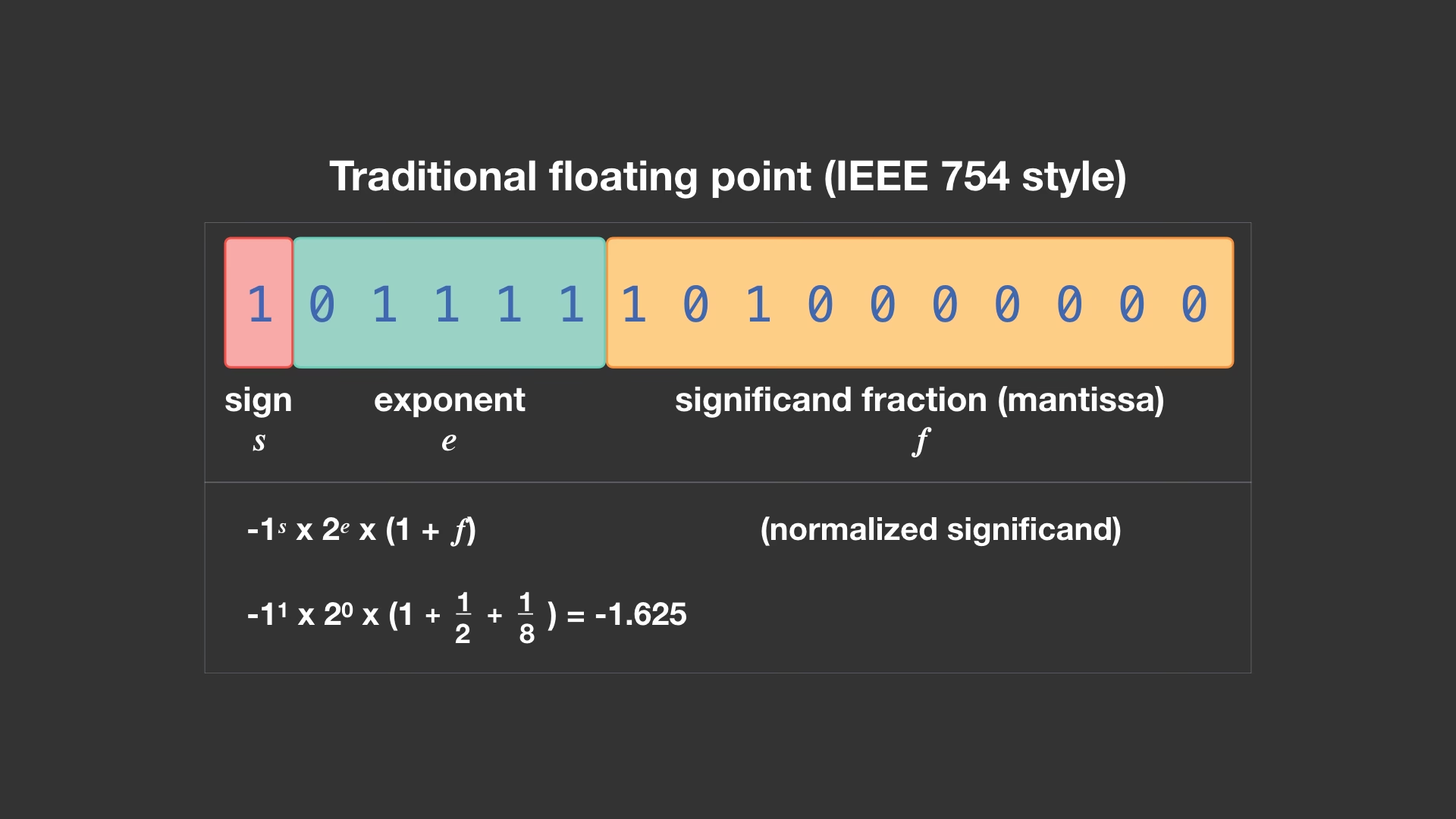

Anatomien af et Floating-Point Tal

Lad os dykke dybere ned i, hvordan de tre dele arbejder sammen. Værdien (V) af et normaliseret tal beregnes generelt ved hjælp af formlen:

V = (-1)S × (1.F) × 2(E - Bias)

Hvor:

- S er fortegnsbitten.

- E er den usignerede værdi af eksponent-bitsene.

- F er værdien af signifikand-bitsene.

- Bias er en fast værdi, der trækkes fra E for at tillade negative eksponenter. For single-precision er bias 127, og for double-precision er den 1023.

Den Skjulte Bit

Du bemærker måske '(1.F)' i formlen. For normaliserede tal (den mest almindelige type) antages det, at det første ciffer i signifikanden altid er 1. Da det altid er 1, er der ingen grund til at spilde en bit på at lagre det. Denne 'skjulte bit' giver os en ekstra bit præcision 'gratis'. For eksempel, hvis de lagrede signifikand-bits er `1010...`, er den faktiske binære signifikand `1.1010...`.

Særlige Værdier: Når Tal Ikke Er Nok

IEEE 754-standarden definerer også repræsentationer for specielle tilfælde, der opstår i matematiske beregninger. Disse håndteres ved at reservere bestemte mønstre i eksponentfeltet.

Nul (og Negativt Nul)

Når både eksponenten og signifikanden er sat til nul, repræsenterer tallet nul. Interessant nok, på grund af fortegnsbitten, findes der både et positivt nul (+0) og et negativt nul (-0). I de fleste sammenligninger er de lig med hinanden, men i visse avancerede matematiske kontekster, som f.eks. grænseværdiberegninger, kan fortegnet have betydning.

Uendelighed (Infinity)

Hvis eksponentfeltet er fyldt med 1'ere, og signifikanden er nul, repræsenterer værdien uendelighed. Dette er resultatet af operationer som at dividere et tal med nul (f.eks. `1.0 / 0.0`). Ligesom med nul findes der både positiv og negativ uendelighed.

NaN - Not a Number

Hvad sker der, hvis du forsøger at beregne kvadratroden af -1 eller dividere nul med nul? Resultatet er matematisk udefineret. I stedet for at lade programmet crashe, returnerer IEEE 754 en speciel værdi kaldet NaN (Not a Number). Dette sker, når eksponentfeltet er fyldt med 1'ere, og signifikanden er forskellig fra nul. En vigtig egenskab ved NaN er, at enhver sammenligning med NaN (selv `NaN == NaN`) altid er falsk.

Præcisionens Faldgruber: Hvorfor 0.1 + 0.2 ≠ 0.3

En af de mest berygtede og forvirrende aspekter ved floating-point aritmetik er, at simple decimalberegninger nogle gange giver uventede resultater. Det klassiske eksempel er `0.1 + 0.2`, som i mange sprog resulterer i noget i retning af `0.30000000000000004`.

Hvorfor sker dette? Årsagen ligger i konverteringen mellem base-10 (decimal), som vi mennesker bruger, og base-2 (binær), som computere bruger. Ligesom brøken 1/3 ikke kan repræsenteres præcist som et endeligt decimaltal (0.333...), kan decimaltallet 0.1 ikke repræsenteres præcist som et endeligt binært tal. Det bliver en uendelig, gentagende binær brøk. Computeren er tvunget til at afrunde tallet for at passe det ind i de tilgængelige 23 eller 52 signifikand-bits. Denne lille afrundingsfejl er normalt ubetydelig, men når man lægger to sådanne afrundede tal sammen, kan fejlene akkumulere og blive synlige.

Dette er grunden til, at man aldrig bør bruge floating-point tal til finansielle beregninger, hvor præcis decimalrepræsentation er afgørende. Til sådanne formål bør man i stedet bruge specielle decimal-typer eller repræsentere beløb som heltal (f.eks. i øre i stedet for kroner).

Sammenligningstabel: Single vs. Double Precision

| Egenskab | Single Precision (float) | Double Precision (double) |

|---|---|---|

| Total bits | 32 | 64 |

| Fortegnsbits | 1 | 1 |

| Eksponentbits | 8 | 11 |

| Signifikandbits | 23 (+1 skjult) | 52 (+1 skjult) |

| Bias for eksponent | 127 | 1023 |

| Decimalpræcision | Ca. 7-8 cifre | Ca. 15-17 cifre |

| Typisk anvendelse | Grafik, spil, hvor hastighed er vigtigere end høj præcision. | Videnskabelige beregninger, finansiel analyse, generel programmering. |

Ofte Stillede Spørgsmål (FAQ)

Hvorfor er IEEE 754-standarden så vigtig?

Standarden sikrer, at floating-point beregninger opfører sig forudsigeligt og konsistent på tværs af forskellige computerarkitekturer og programmeringssprog. Uden den ville det være en stor udfordring at skrive portabel kode, der involverer matematik med reelle tal.

Hvad er forskellen på en 'float' og en 'double'?

Den primære forskel er præcision og rækkevidde. En 'double' (double-precision) bruger 64 bits, hvilket giver mulighed for at repræsentere tal med langt større præcision og et meget bredere spænd af værdier end en 'float' (single-precision), der kun bruger 32 bits. Som standard er det ofte bedst at bruge 'double', medmindre man har specifikke grunde til at spare hukommelse eller har brug for den marginalt højere ydeevne, som 'float' kan give i visse applikationer som 3D-grafik.

Hvad betyder NaN, og hvordan håndterer jeg det?

NaN står for 'Not a Number' og er resultatet af en matematisk operation, der ikke har en defineret reel talværdi, såsom 0/0. Den vigtigste ting at huske er, at NaN ikke er lig med noget, heller ikke sig selv. For at tjekke for NaN skal du bruge en speciel funktion, som f.eks. `isNaN()` i mange sprog, i stedet for at bruge `==` operatøren.

Hvordan undgår jeg problemer med afrundingsfejl?

For det første, vær opmærksom på, at de eksisterer. Undgå at sammenligne to floating-point tal for eksakt lighed. I stedet for `if (a == b)`, bør du tjekke, om den absolutte forskel mellem dem er mindre end en meget lille toleranceværdi (kaldet en epsilon): `if (abs(a - b) < epsilon)`. For det andet, hvis du arbejder med penge eller andre værdier, der kræver præcis decimalaritmetik, skal du bruge en decimal-datatype, hvis dit sprog understøtter det, eller arbejde med heltal.

Hvis du vil læse andre artikler, der ligner Forstå Floating-Point Aritmetik: En Guide, kan du besøge kategorien Teknologi.