24/07/2000

I en verden, hvor teknologi konstant skubber grænserne for, hvad der er muligt, er sundhedssektoren ingen undtagelse. Forestil dig en fremtid, hvor en kunstig intelligens (AI) kan analysere et medicinsk billede og stille en præcis diagnose på sekunder. Denne fremtid er måske tættere på, end vi tror. En nylig og omfattende undersøgelse har sat de mest avancerede multimodale AI-modeller på den ultimative prøve mod menneskelig ekspertise i en prestigefyldt medicinsk udfordring. Resultaterne er både forbløffende og tankevækkende, og de tegner et billede af en fremtid, hvor samarbejdet mellem menneske og maskine bliver nøglen til bedre diagnostik.

Testen: The New England Journal of Medicine's Image Challenge

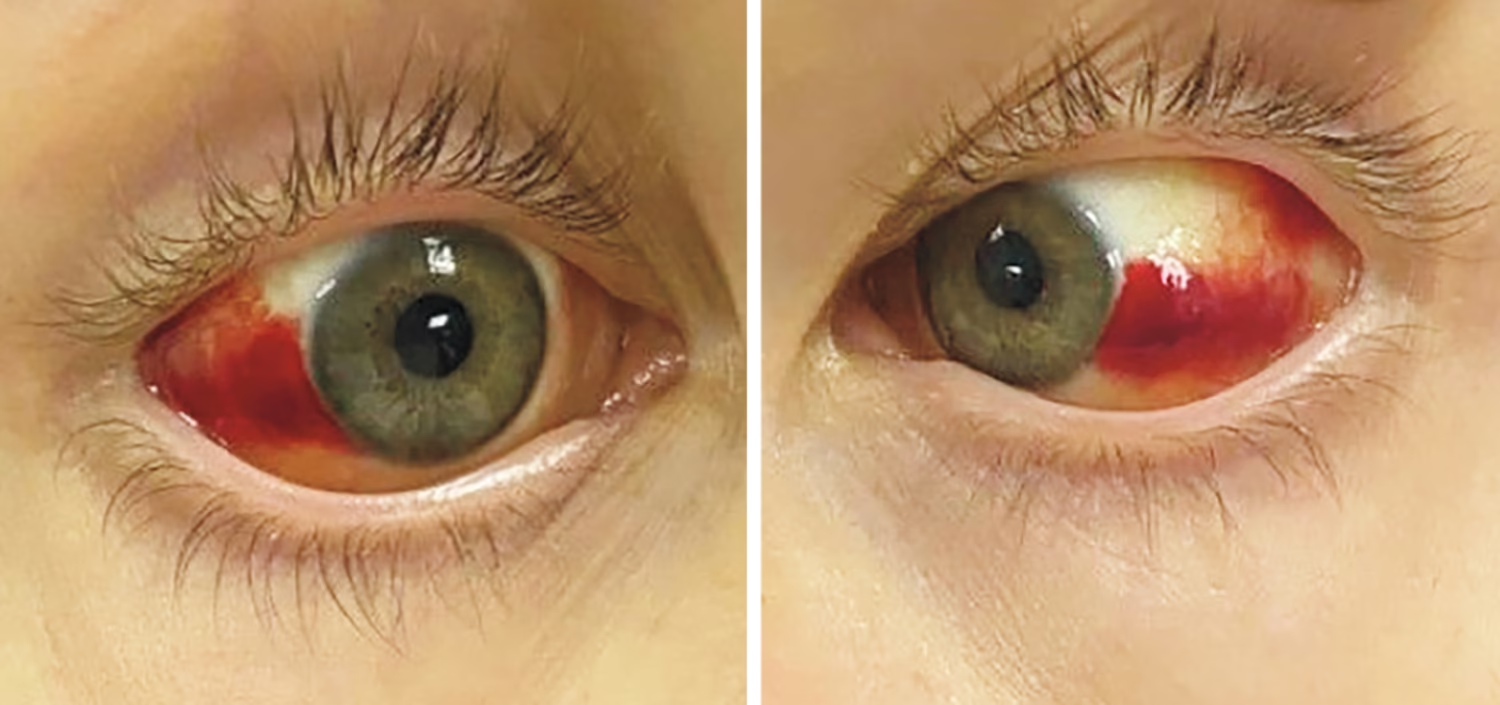

For at evaluere AI-modellernes diagnostiske evner blev der brugt data fra en højt anset kilde: The New England Journal of Medicine (NEJM) Image Challenge. Dette er en ugentlig online quiz, hvor læger og medicinstuderende fra hele verden præsenteres for et medicinsk billede, en kort patienthistorie og et multiple-choice-spørgsmål. Udfordringen er designet til at teste og skærpe kliniske diagnostiske færdigheder.

Undersøgelsen analyserede en enorm mængde data, der dækkede 945 forskellige sager publiceret siden 2005, med over 85 millioner svar fra mennesker. Dette rige datasæt gav et solidt grundlag for at sammenligne AI's præstationer med et bredt udsnit af menneskelige deltagere. Sværhedsgraden af sagerne varierede betydeligt, med en gennemsnitlig korrekt svarprocent blandt mennesker på omkring 49,4 %, hvilket vidner om udfordringens komplekse natur.

AI-modellerne under lup

Flere af de mest avancerede AI-modeller, der kan fortolke både tekst og billeder (multimodale modeller), blev inkluderet i testen. Blandt disse var kendte navne som OpenAI's GPT-4 Vision Preview, Googles Gemini 1.0 Pro Vision og en række modeller fra Anthropic's Claude 3-familie (Opus, Sonnet og Haiku). Ved at teste en bred vifte af modeller kunne forskerne få et nuanceret billede af den nuværende teknologis formåen.

Overraskende resultater: AI overgår den gennemsnitlige person

Et af de mest slående resultater var, at de bedste AI-modeller klarede sig markant bedre end den gennemsnitlige menneskelige deltager. Specifikt opnåede Anthropic's Claude 3-modeller en nøjagtighed på omkring 59 %. Dette er næsten 10 procentpoint højere end den gennemsnitlige menneskelige score på 49,4 %. Det viser, at AI har en imponerende evne til at genkende mønstre og drage konklusioner fra komplekse medicinske billeder og tilhørende klinisk information. Især den mindste og hurtigste model, Claude 3 Haiku, klarede sig bedst, hvilket indikerer, at den største model ikke altid er den bedste til specifikke opgaver. Disse resultater understreger, at AI har potentialet til at blive et yderst værdifuldt værktøj, der kan assistere læger i deres daglige arbejde.

Den uovertrufne kraft: Menneskelig kollektiv intelligens

Selvom AI's individuelle præstation var imponerende, afslørede undersøgelsen en endnu stærkere kraft: menneskelig kollektiv intelligens. Når forskerne så på 'flertalsafgørelsen' – altså det svar, som flest mennesker havde valgt for hver enkelt sag – steg nøjagtigheden til svimlende 90,8 %. Dette fænomen, også kendt som 'swarm intelligence', viser, at selvom individuelle læger kan tage fejl, er den samlede viden og erfaring fra en stor gruppe eksperter ekstremt pålidelig og langt overlegen i forhold til enhver nuværende AI-model. Det er en stærk påmindelse om, at erfaring, intuition og den kollektive diskussion blandt fagfolk stadig er uundværlig i medicinsk diagnostik.

Ikke alle AI'er opfører sig ens

Et andet interessant fund var den store forskel i AI-modellernes adfærd. Mens de fleste modeller forsøgte at besvare alle spørgsmål, nægtede OpenAI's GPT-4 Vision Preview at svare på næsten en fjerdedel (24 %) af sagerne. Modellen var mere tilbøjelig til at undlade at svare på spørgsmål, som den anså for at være sværere, eller som havde billeder i højere opløsning. Dette 'selektive' svar-mønster rejser vigtige spørgsmål om pålideligheden og gennemsigtigheden af visse AI-systemer. Hvis en AI kun svarer, når den er sikker, kan det begrænse dens anvendelighed i den virkelige verdens uforudsigelige kliniske situationer. Denne tilbageholdenhed skyldes sandsynligvis strenge sikkerhedsfiltre, der skal forhindre, at AI'en giver ukorrekte medicinske råd, men det fremhæver også en af de nuværende begrænsninger.

Sammenligning: AI vs. Menneskelig Ekspertise

For at give et klart overblik er her en tabel, der sammenligner de to tilgange baseret på undersøgelsens resultater:

| Egenskab | Kunstig Intelligens (AI) | Menneskelig Ekspertise |

|---|---|---|

| Individuel Nøjagtighed | Høj (bedste modeller ~59%) | Variabel (gennemsnit 49,4%) |

| Kollektiv Nøjagtighed | Ikke sammenlignelig | Meget høj (90,8% ved flertalsafgørelse) |

| Hastighed | Næsten øjeblikkelig | Kræver tid til analyse og overvejelse |

| Pålidelighed | Variabel (nogle modeller nægter at svare) | Generelt høj, men underlagt menneskelige fejl |

| Gennemsigtighed | Ofte en 'sort boks', svær at forklare | Kan forklare ræsonnement og tankeproces |

Fremtiden er et samarbejde, ikke en erstatning

Denne undersøgelse viser tydeligt, at AI ikke er på vej til at erstatte læger. I stedet peger den på en fremtid, hvor AI fungerer som et kraftfuldt diagnostisk værktøj. En AI kan hurtigt analysere store mængder data, identificere subtile mønstre, som det menneskelige øje måske overser, og foreslå sandsynlige diagnoser. Dette kan frigøre lægens tid og mentale kapacitet til at fokusere på de mere komplekse aspekter af patientbehandling: at forstå patientens fulde kontekst, kommunikere med empati og træffe den endelige, velovervejede beslutning. Særligt inden for specialer som dermatologi og radiologi, hvor billedanalyse er central, viser AI allerede et enormt potentiale.

For at denne fremtid kan realiseres sikkert og etisk, er der behov for regulering. EU har for nylig vedtaget EU AI Act, en lovgivning, der stiller strenge krav til højrisiko-AI, herunder systemer brugt i sundhedsvæsenet. Loven kræver gennemsigtighed, robusthed og menneskeligt tilsyn, hvilket er afgørende for at sikre patientsikkerheden. Fremtidig forskning skal også fokusere på at udvikle specialiserede AI-modeller, der er trænet specifikt til medicinske opgaver, samt at validere deres effektivitet i kliniske forsøg.

Ofte Stillede Spørgsmål (FAQ)

Kan jeg bruge en AI til at diagnosticere mig selv?

Nej, det frarådes på det kraftigste. De nuværende AI-modeller er ikke godkendt som medicinsk udstyr og er stadig under udvikling. De kan lave fejl og mangler den fulde kliniske forståelse, som en læge besidder. Kontakt altid en autoriseret sundhedsprofessionel for enhver medicinsk bekymring.

Hvilken AI var bedst i testen?

Modellerne fra Anthropic's Claude 3-familie, især Claude 3 Haiku, opnåede den højeste nøjagtighed blandt de testede AI-modeller og overgik den gennemsnitlige menneskelige deltager.

Hvorfor er kollektiv menneskelig intelligens bedre end AI?

Kollektiv intelligens samler viden, erfaring og intuition fra mange eksperter. Denne proces hjælper med at udligne individuelle fejl, fordomme og blinde vinkler, hvilket fører til en langt mere robust og pålidelig konklusion end hvad en enkelt person eller en enkelt AI-model kan opnå.

Hvad betyder EU's AI Act for medicinsk AI?

EU's AI Act klassificerer medicinsk AI som et højrisikosystem. Det betyder, at udviklere skal overholde strenge regler for at sikre, at deres systemer er sikre, pålidelige og gennemsigtige. Dette inkluderer krav om grundig testning, klar dokumentation og muligheden for menneskeligt tilsyn for at beskytte patienterne.

Hvis du vil læse andre artikler, der ligner AI mod læger: Hvem stiller den bedste diagnose?, kan du besøge kategorien Sundhed.